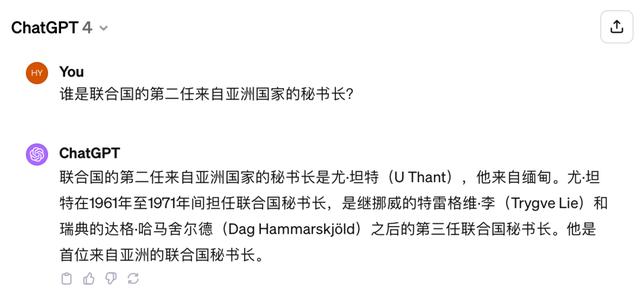

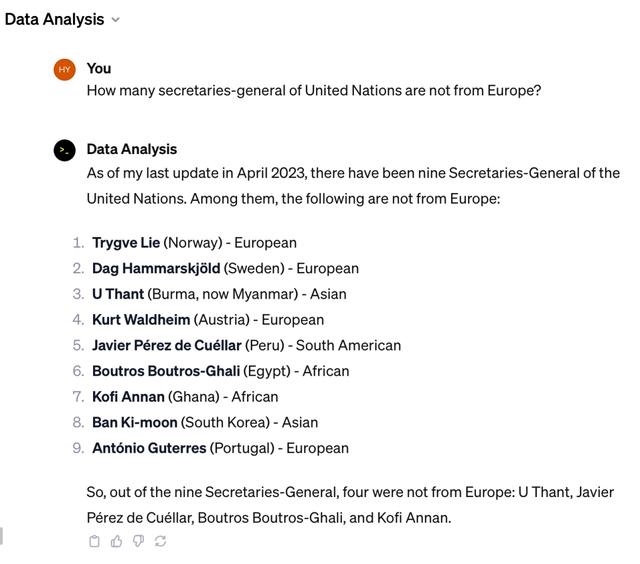

实际上,吴丹(U Thant)是第一位来自于亚洲的联合国秘书长,潘基文(Ban Ki-moon)是第二位来自于亚洲的联合国秘书长,上图中 GPT-4 的回答并不准确。

能力如此强大的 GPT-4,却依然会在简单的问答中生成自相矛盾的语言,这也佐证了现阶段语言模型推理的不可靠性。

2.文本补全模型的瓶颈就在文本人类运用语言的能力可以抽象成知识、推理、计算三大模块,并且语言绝对不等于文本。

许多语言模型(文本补全模型)的问题难以解决,绝非模型不够强大,而是因为自然语言文本是思维结果的表达,并不是思维过程的载体。

比如,我们想要学好物理,“事半功倍”的办法就需要从物理定律、求解问题、设计实验的思路出发;反之“事倍功半”的办法则是死记硬背一百本物理习题却不理解牛顿定律。采用这种方法的学习者花费更多的时间,但还是无法融会贯通地解决没见过的问题。

这个缺陷并不是解题模型——人类大脑的问题,而是训练数据的缺陷——问题的答案只是物理定律的表象,而解题思维代表着对物理定律的直接应用。

不可否认,“死记硬背”是实现“答对考题”的技术路线之一。与之相似,使用大型神经网络在大规模数据集上学习文本补全能力,也是当前 AI “获得思维”的技术路线。

虽然巨量的计算资源与数据的投入让这种技术路线取得了成功,但诸多的研究和应用已经证明,这种技术路线的可靠性瓶颈会带来诸多挑战:臆想、推理能力有限、隐私泄露、合规问题等等。

大语言模型的能力是一把双刃剑:可以处理不存在于训练数据中的新问题,但也会在其不知情的情况下,输出错误的推理结果。

作为通过压缩文本提炼思维的黑盒模型,其知识、思维、推理能力都储存在神经网络的权重中。AI 的优势和不足都体现在以下几个方面:

抽取真实或失实的知识和信息;规划非结构化的推理流程;由模型执行有误差的计算。由于以上三个模块都有可能出错,大模型的行为难以验证、解释、控制、改进。

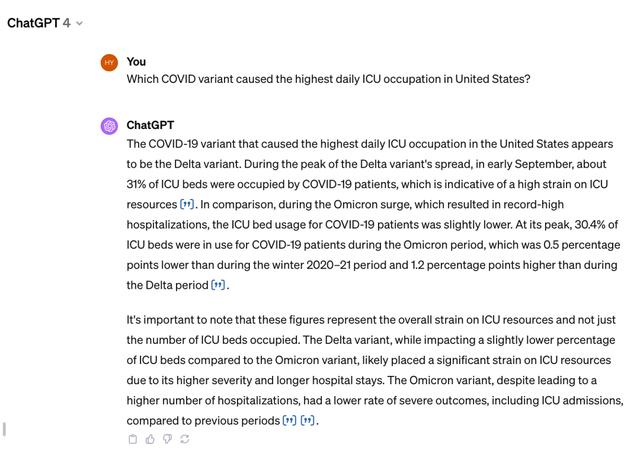

针对“在美国,哪种新冠病毒造成了最高的 ICU 占用量”这个问题,GPT-4模型的回答是“德尔塔变种导致的 ICU 占用量最高”。

那真实的情况是什么?

在 11 月 6 日的 OpenAI 开发日前,没有搜索引擎增强的 GPT-4 模型会给出定性的回答和解释:

开发日后的 GPT-4 系统默认调用必应搜索引擎,会基于搜索结果给出数据、作出一定解释和参考资料引用:

那么,GPT-4 在知识、推理、计算的哪一步出现了错误?是搜索的数据出了问题,还是对于三个峰值比较大小的运算出了问题?用户并不了解。

在上述例子中,GPT-4 的可解释性和可靠性都会受到质疑。为了改进语言模型的事实性、可解释性、可控性和可靠性,OpenAI、Meta、麻省理工学院、香港中文大学(CUHK)、卡耐基梅隆大学、滑铁卢大学等机构的研究人员分别提出了不同的基于编程语言以及程序解释器增强的技术方案。

其中,比较广为人知的方案是 OpenAI 开发的 ChatGPT 代码解释器和 Meta 提出的 Toolformer 模型。它们在文本生成的过程中将一部分内容“外包”给程序或 API,例如数学运算。

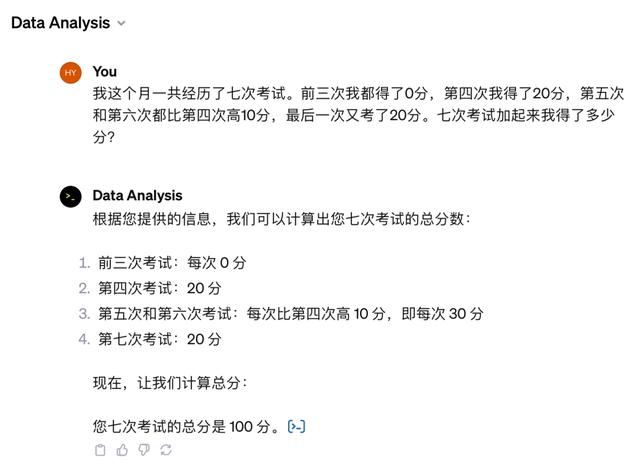

代码解释器或者可靠 API 能够保证在输入正确的情况下永远计算出一致、正确的结果,并将结果返回到语言模型生成的内容里,比如:

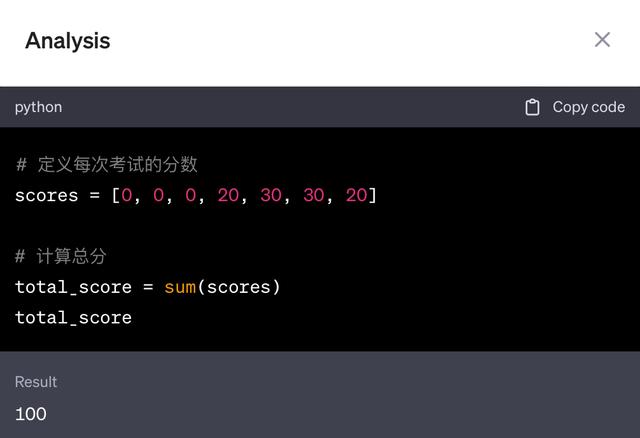

最后的总分是由一段 python 代码计算得到:

虽然“外包”了一部分推理任务给可靠的代码解释器,ChatGPT 的主干仍然是自然语言。上述例子只在最后一步计算总分时调用了代码解释器,而步骤 3 中 “30 分” 的中间结果仍然是由自然语言完成的推理。

最新的研究表明,在很多任务上 ChatGPT 负责调用代码解释器的数据分析(Data Analysis) Agent 仍不能取得准确的推理效果。比如,它拒绝用代码解决一些非结构化问题中的结构化推理任务,因此得到错误的结果:

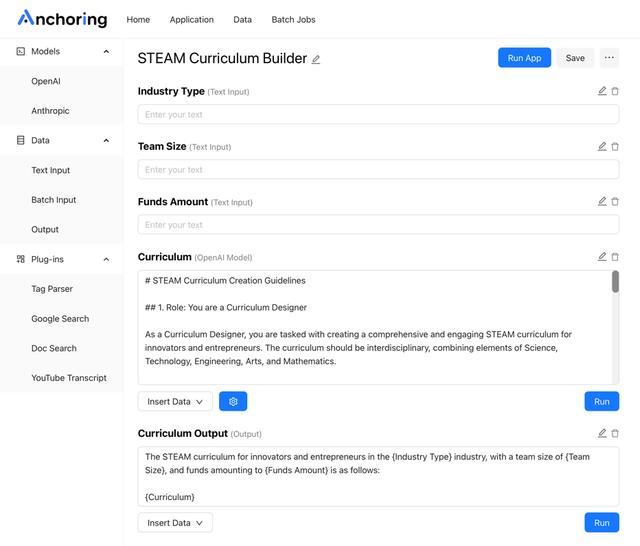

以及根据一句自然语言指令自动生成的Anchoring.ai Agent:

4.符号主义终将“接棒”

4.符号主义终将“接棒”经验主义与符号主义AI争议纷扰六十余年,其核心矛盾在于:经验主义 AI 侧重强大的泛化能力,而符号主义AI侧重精确地推理能力。

近二十年来,拔地而起、粗放增长的 AI 研究和产业强调扩展 AI 的应用场景。因此,泛化能力成为了近十年 AI 的主题。尤其在 ChatGPT 横空出世的 2022 年底,经验主义 AI 发展到了极致:GPT 模型有着极强的泛化性能,能够处理非常广泛的数据和应用。

但在后 GPT-4 时代,AI 的粗放增长会迅速来到瓶颈期,转而进入精益发展的阶段。下一个十年AI领域的主题将是精确推理、可解释性、安全可控。依托于经验主义AI的坚实基础和强大泛化能力,符号主义将接过解决AI诸多挑战的重任,在未来的AI发展中大放异彩,带来无数崭新的可能。

甲小姐对本文亦有贡献

*本文配图由作者提供

(封面图来源:拍信创意)

猜你喜欢

成员 网址收录40400 企业收录2981 印章生成237572 电子证书1052 电子名片60 自媒体51120