人工智能技术的发展,也给科研论文的审核带来很大的困扰和难题。这两天,一篇刊登在Nature上的新闻表示,GPT-4生成的造假数据集,第一眼还真不一定看得出来,除非请来业内专家仔细对数据集进行评估,才能发现个中细节的不合理性。

这个新闻的来源是一篇发表在国际权威医学期刊《美国医学会杂志· 眼科学卷》(JAMA Ophthalmology)上的论文,该论文使用GPT-4为一项医学学术研究生成了一个假数据集,发现它不仅能创造出看似真实合理的数据,甚至还能用来准确支撑错误的论文观点。

很多科研论文都属于基础性质的研究,研究数据造假对后续研究会产生很大的误导,应用性质比较强的科研论文,研究数据造假有时产生的危害更要大得多。譬如导致工程设计出现问题就会留下安全隐患;与人的生命安全直接相关的医学论文,甚至还有可能因为受到论文中造假数据的影响而威胁生命健康。所以论文审核在ChatGPT不断升级的技术面前如何设置好“防火墙”就变得至关重要。唯有设定相应的规则,制定更为严厉的处罚措施,才能很好地约束研究人员规范使用ChatGPT。科学共同体在其中能够发挥作用,则更是关键。

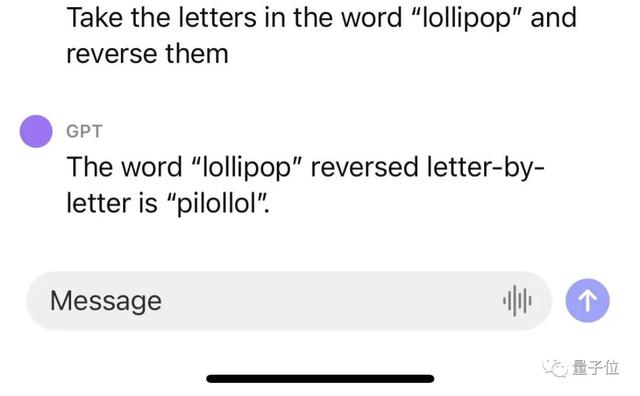

即使没有造假企图的研究人员,也要谨慎使用ChatGPT帮助自己研究。虽然ChatGPT的发展为科学研究带来了很多帮助,在数据分析及复杂运算方面,它都是一个很好的工具,然而现在人工智能构建的绝大部分模型都还不是尽善尽美,有研究者形象地说,“当前最先进的神经网络模型其实与醉酒的人相似”,“他们都努力与人互动、跟随简单指令生成信息,少数还试图驾驶交通工具”,其可靠性可想而知。很多时候这些人工智能平台自动生成的结果还不足以让人信赖,如果过于相信其生成的结果,而不通过人的智慧进行核验,有时有可能会给自己“挖一个大坑”。

我们都说“魔高一尺道高一丈”,这个规则在人工智能高速发展的今天依旧适用。在科学研究领域,只要所有的研究机构、研究人员坚守正道,守住科研伦理底线,科学共同体对不管哪种形式的研究造假都有充分的制衡之术,GPT-4成学术造假“神器”就不是太大的问题。

福利来啦!

为回馈广大用户

科协之声

送福利啦~

即刻起至明日上午10:00

只要在后台留下

您的姓名、联系方式

(只限北京用户)

就可获得

厦门大学原创话剧

《哥德巴赫猜想》门票一张

数量有限

先到先得哦

门票领取方式:现场领取

演出时间:11月28日19:30

演出地点:国家大剧院台湖剧场

(北京市通州区台湖西路6号)

本文封面图及配图来自版权图库,不授权转载

相关文章

猜你喜欢