封面新闻记者 车家竹

当你输入一个想法,一个问题,它能够理解,给出回答,它通常会谈及它所了解到的信息,或者告诉你应该去哪些地方寻求帮助。你利用这些信息集思广益,结合自己的经验来重塑想法、完善观点,新的idea就此诞生......

它是谁?

它是ChatGPT。

计算机科学之父、人工智能之父:艾伦·图灵

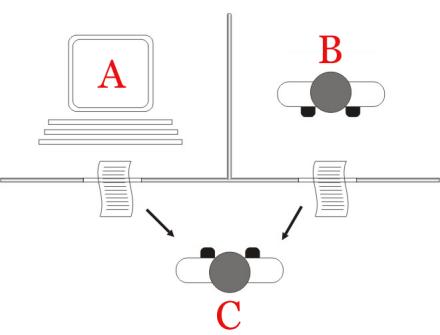

图灵测试,也就是图灵所说的“模仿游戏”的操作很简单:一位询问者将自己的问题写下来,发给处于另外一个房间之中的一个人和一台机器,然后根据他们给出的答案确定哪个是真人——如果无法判断或混淆了被考察的机器和人,则可认为被测试的机器具有某种程度的智慧 从此,通过图灵测试成为了人类在AI领域为之奋斗的里程碑目标。

ChatGPT发展路径

技术本质:大型语言模型的应用

Transformer、InstructGPT、AIGC、自监督学习、位置编码......

ChatGPT横空出世后,伴随而来的是大量AI概念,各种术语让人眼花缭乱,但ChatGPT背后的技术本质,其实是大型语言模型(LLM)的应用。

大型语言模型是由十亿或更多的参数的神经网络组成的语言模型,使用无/半监督学习对大量样本进行训练。目前,大型语言模型已经改变了许多领域,包括自然语言处理、计算机视觉等。作为一个通用的语言模型,其用途广泛,而非针对一项特定任务(例如情感分析、命名实体识别或数学推理)进行训练。

大模型的出现是否对科学研究领域是否带来了冲击?对此,重庆大学微电子与通信工程学院的张磊教授向记者表示:“我的研究方向是做开放环境的视觉感知的一系列任务,我关心的问题是怎么让视觉模型在开放环境的感知的时候具备比较强的鲁棒性、泛化性。大模型来了之后,这个问题可能会变得更加复杂。大模型它的特点是两大要素,模型大、数据大,天然具备开放环境的优势,它会帮助我们更好解决开放环境上的任务,但同时也会带来更大的挑战。因为我本身是做适配、做泛化、做迁移的,接下来就是以大模型为基础,利用预训练的大模型去做一些下游的任务的适配。所以大模型对我来说是一种帮助,我个人是非常拥抱大模型的。”

重庆大学电子信息工程系张磊教授

随着大模型的出现,研究领域未来趋势预测又会是怎样?刚参加完第七届亚洲人工智能技术大会的张磊教授分析到:“现在大模型是算力的堆积加数据的堆积,但是这一定不是未来的状态。我对未来人工智能发展第一个看法是,跟类脑结合,即不应该是现在这种往大了发展的大模型,而是往类脑这个角度发展。第二个看法是从算法角度来说,未来不是大模型,而是小模型。这个小模型跟大模型之前的小模型,不是同一个小模型,而是说受到了大模型的指导、影响之后的一个小模型。”

“未来的天下应该是属于这个小模型的,因为我们要涉及很多的领域,不仅是在自然语言领域,也不仅是在视觉领域,还有很多的垂直领域里面不可能都会去训练大模型,但是可以去借助大模型的知识来辅助小模型的训练。”

怎样去理解张教授所提及的“小模型”,他举例补充到:“就像人的学习一样,不可能上来就把小学到博士的所有的教材全部甩给一个小朋友,让他自己去学,我们需要老师来教授知识。可以把老师理解成一个很大的模型,他是经过了很多年的锤炼,成为一个大模型,但是要去教一个小朋友的时候,可以用一个老师去教给他,那这时候他接触就比较快,比自己去看书要学得快得多。”

ChatGPT官网

智能未来:AI继续加速?

ChatGPT标志着里程碑式的技术进步,在最具挑战性的自然语言处理领域实现了革命性突破。相比视频、图像、语音等,自然语言的语法、语义、逻辑复杂,存在多样性、多义性、歧义性等特点。因此,长期以来自然语言处理被认为是人工智能最具挑战性的领域。高质量的自然语言理解和生成,并且能够进行零样本学习和多语言处理,为自然语言处理领域带来了前所未有的突破。

人工智能在不同场景应用需要训练不同模型,而ChatGPT可完成人机对话、机器翻译、编码测试等多种任务,已经具备通用人工智能的一些核心技术和特征:能够自动化地学习各种知识、信息,不断自我优化;充分理解和流畅表达人类语言,逻辑推理强,实现了具备一般人类智慧的机器智能;也在不断证明着大模型的学习和进化能力,目前大模型智能程度已接近人类水平,甚至一些业界人士认为,将来会逐渐产生自我认知和感知,进而出现意识并且超越人类。

或许我们还在猜测人工智能是否会像互联网、社交媒体和智能手机那样带来世界变革。但不可否认的是,AI技术的出现是技术的飞跃,也正在重组我们的生活方式......

(图片源自于网络)

【如果您有新闻线索,欢迎向我们报料,一经采纳有费用酬谢。报料微信关注:ihxdsb,报料QQ:3386405712】

相关文章

猜你喜欢

成员 网址收录40404 企业收录2983 印章生成239510 电子证书1065 电子名片60 自媒体60974