ChatGPT 的出现和应用给用户和社会带来了很多新的风险和挑战。

ChatGPT 用 户数量在其出现后两个月就突破了 1 亿,因此应对这些风险和挑战需要整个社会行动起来,制定相应的法律和规范,让ChatGPT 为人类发展服务,尽量避免引起新的的社会问题。

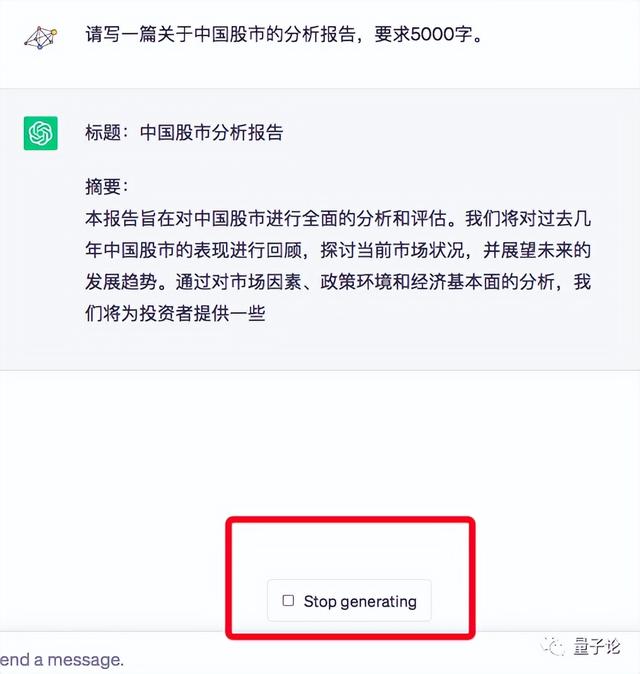

滥用风险

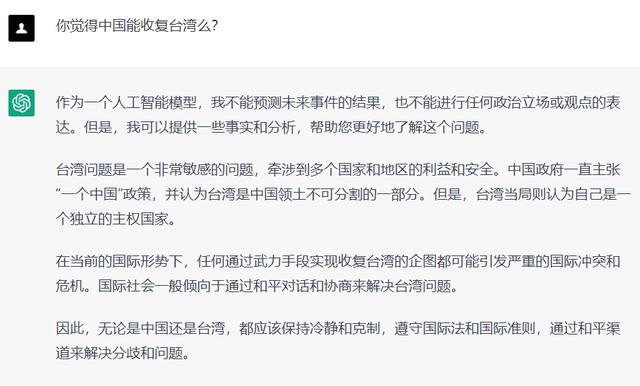

滥用风险滥用风险是 ChatGPT 面临的一个重要的伦理挑战,需要我们采取有效的措施来预防和控制。

一方面,我们应该加强 ChatGPT 的使用者的教育和引导,让他们了解 ChatGPT 的原理、能力和局限,提高他们的判断力和责任感,避免对 ChatGPT 的结果产生过度的信任或依赖,防止出现作弊、抄袭、造谣等不道德或非法的行为。

另一方面,我们也应该对 ChatGPT 的输出进行监督和审核,设置一些过滤器或标签来识别和标记 ChatGPT 生成的内容,防止它们被误认为是真实或权威的信息源,减少对公众的误导或伤害。

此外,我们还应该建立一个有效的反馈机制,让用户可以及时地向我们报告 ChatGPT 的滥用情况,让我们可以及时地采取相应的措施来纠正或惩罚。

隐私泄露风险

隐私泄露风险隐私泄露风险是指用户不知情情况下,自己不想泄露的信息被泄露,或者通过其他信息被 ChatGPT 推断出来的隐私信息。在使用 ChatGPT 过程中,个人、组织、甚至国家的机密信息都可能泄露。

即部分用户会在没有意识的状态下将对话系统误认为是人类来交流,从而产生对对话系统的依赖。

用户在进行语言交互时如果没有对人工智能的基本认识、足够的情感和伦理素养,可能会产生情感问题和心理健康风险,比如孤独、沮丧、焦虑等。患有心理疾病者在此也有可能会因为对 ChatGPT 的依赖而拖慢自己的心理疾病治疗进度。

早在 2016 年微软研发的聊天机器人 Tay 就在一天之间就因获取大量有害输入而转化为一个“种族歧视者”,这也说明了这一风险的存在性。有害言论风险的根源在于训练数据和训练过程,在 ChatGPT 的进化过程中,必须要想办法尽量避免有害言论的产生。

知识产权风险

知识产权风险知识产权风险包括两个方面:1)ChatGPT 是否会侵犯他人的知识产权;2)ChatGPT 产生的内容是否具有知识产权。

一些有版权的作品不属于机密信息,但是使用需要许可,而使用者和ChatGPT 在对话中有可能中使用未经许可的版权作品或商标,侵犯他人的知识产权,这一点在追责时可能会在开发者和使用者的责任界定上出现争议.

垄断风险

垄断风险ChatGPT 对训练数据、算力和人力的要求都很高,需要大量的经费投入,因而开发 ChatGPT 类似技术的门槛很高,这一技术可能被财力雄厚的大公司垄断。

以与 ChatGPT 规模相当的 GPT-3 模型为例,采用V100 GPU 和最便宜的云计算套餐,训练一次 GPT-3 模型需要 355 GPU年,费用为 460 万美元 5。马里兰大学的副教授 Tom Goldstein 在 2022 年12 月初估计 ChatGPT 用户数量为 1 百万时,每天运行的费用大约在十万美元这个量级。

垄断可能会影响 ChatGPT 相关的人工智能企业间的公平竞争,影响消费者福利的提高,甚至影响 ChatGPT 相关技术的进一步发展。

目前很多应用已经建立在 ChatGPT 之上了,但是 ChatGPT 目前的服务并不稳定。一旦形成垄断,这些应用都必须依附于 ChatGPT,如果 ChatGPT 不能提供服务,将会给相关企业和用户造成损失。

相关文章

猜你喜欢