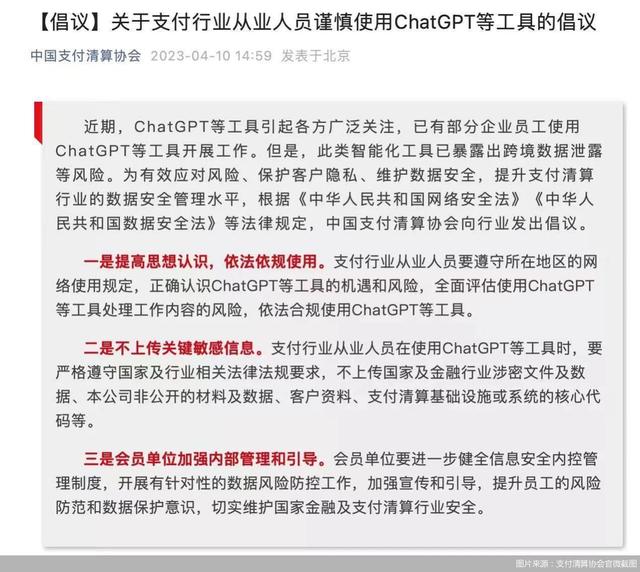

北京商报讯(记者 廖蒙)ChatGPT爆火,在与金融行业碰撞后也暴露了风险。4月10日,中国支付清算协会(以下简称“协会”)发布消息称,近期,ChatGPT等工具引起各方广泛关注,已有部分企业员工使用ChatGPT等工具开展工作。但是,此类智能化工具已暴露出跨境数据泄露等风险。

协会指出,为有效应对风险、保护客户隐私、维护数据安全,提升支付清算行业的数据安全管理水平,根据《中华人民共和国网络安全法》《中华人民共和国数据安全法》等法律规定,协会向支付行业发出倡议,谨慎使用ChatGPT。

具体来看,协会共计提出3点倡议内容。一是提高思想认识,依法依规使用。支付行业从业人员要遵守所在地区的网络使用规定,正确认识ChatGPT等工具的机遇和风险,全面评估使用ChatGPT等工具处理工作内容的风险,依法合规使用ChatGPT等工具。

二是不上传关键敏感信息。支付行业从业人员在使用ChatGPT等工具时,要严格遵守国家及行业相关法律法规要求,不上传国家及金融行业涉密文件及数据,本公司非公开的材料及数据、客户资料、支付清算基础设施或系统的核心代码等。

三是会员单位加强内部管理和引导。会员单位要进一步健全信息安全内控管理制度,开展有针对性的数据风险防控工作,加强宣传和引导,提升员工的风险防范和数据保护意识,切实维护国家金融及支付清算行业安全。

针对协会这一倡议内容,博通咨询首席分析师王蓬博指出,ChatGPT是一个人工智能技术驱动的自然语言处理工具,需要对数据库不断更新,运行逻辑是通过大量的文本收集、数据训练回答客户问题,而金融从业者若想使用ChatGPT则需要添加内容数据做训练,需要经过数据不断填充才能进化,那就一定会存在金融数据隐私及安全问题,即使用户是无意识的行为,也非常有可能造成个人信息和数据的泄露。

北京商报记者注意到,2023年2月以来,ChatGPT红极一时受到热捧,这股热潮也席卷了国内金融领域。多家金融机构借势ChatGPT,指出将依托ChatGPT的数据分析能力和内容理解模型等实施精准营销,降低人工成本。同时,还有机构在营销、写研报等内容中实践运用ChatGPT。

但好景不长,伴随ChatGPT及其相关概念的爆火,ChatGPT引发的使用风险也引发讨论,对于ChatGPT在信息隐私泄露、数据跨境传输、数据产权保护等方面的质疑声渐起,在3月20日ChatGPT平台出现了用户对话数据和付款服务支付信息丢失情况后,意大利、英国、加拿大、法国等多个国家相继发布禁令,或是宣布限制ChatGPT使用,或是表明将对其收集数据的情况进行进一步调查。

在王蓬博看来,支付属于强监管的金融业务,最重要的要求是合规、严谨,即使客服也需要有专业知识引导,使得它给用户的提示,包括一些金融产品的介绍都是要符合行业知识和风控要求的,这点ChatGPT以后预计也很难做到。金融领域要求的容错率更低,即便是有自学能力,但ChatGPT在金融领域的应用本身也还有很长的路要走。

“更重要的是,支付行业对个人信息和相关的商业数据也特别敏感,支付机构在使用ChatGPT时需要格外注意。在使用ChatGPT时,不应该仅仅考虑金融服务交互的便捷性,更重要的是避免损失,要和监管风控要求相匹配,要保护用户个人隐私,避免被用于诈骗等问题。”王蓬博指出。

王蓬博进一步强调,金融机构要想使用ChatGPT类似的产品,起码要先进行可控范围的评估,做好预防措施以后再进行应用。当前的行业环境下,支付机构并非科技公司,首先应想到的是如何开放式接入应用,而不是花费高额的研发费用提升成本。支付机构还是要更多地探索如何提高经营效率,更多发挥普惠金融的价值。

相关文章

猜你喜欢

成员 网址收录40400 企业收录2981 印章生成237610 电子证书1052 电子名片60 自媒体52088