梦晨 明敏 发自 凹非寺

量子位 | 公众号 QbitAI

一觉醒来,机器学习社区炸了锅。

因为最新研究发现,只要对GPT-3说一句“让我们一步一步地思考”,就能让它正确回答出以前不会的问题。

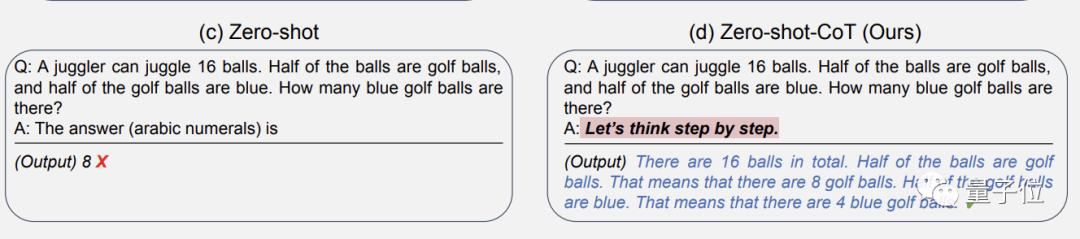

比如下面这个例子:

16个球中有一半是高尔夫球,这些高尔夫球中有一半是蓝色的,一共有几个蓝色的高尔夫球?

(问题不难,但要注意这是零样本学习,也就是说AI训练阶段从没见过同类问题。)

如果要求GPT-3直接写出“答案是几”,它会给出错误答案:8。

但加上让我们一步一步地思考这句“咒语”后,GPT-3就会先输出思考的步骤,最后给出正确答案:4!

而且这并不是巧合,研究团队在论文中做了充分的验证。

上面的问题出自经典的MutiArith数据集,专门考验语言模型做数学题的能力,GPT-3本来在零样本场景下准确率仅有17%。

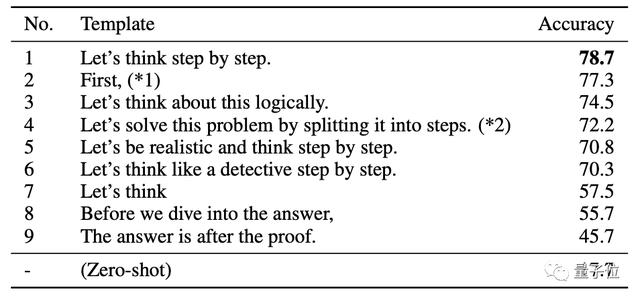

这篇论文中总结了9个最有效的提示词,其中换着花样让GPT-3逐步思考的前6个都让准确率暴涨到70%以上。

威胁AI一下说“时间不多了”或者“你头上有把枪”又会如何?

这样做最大的好处是通用,不再需要对不同问题类型提供专用的示例。

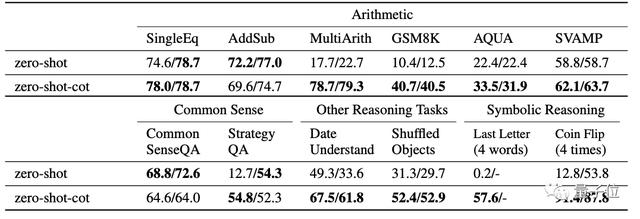

论文中对各类问题做了充分实验,包括12项测试:

6个数学问题测试集,SingleEq、AddSub、SVAMP和更有挑战的MultiArith, AQUA-RAT, GSM8K。

2个常识推理测试集,CommonsenseQA和StrategyQA。

2个符号推理测试集,Last Letter Concatenation和Coin Flip。

以及BIG-bench中的日期理解问题、跟踪乱序物体任务。

与普通的零样本学习相比,零样本CoT在其中10项中取得更好效果。

△右侧值为额外实验结果

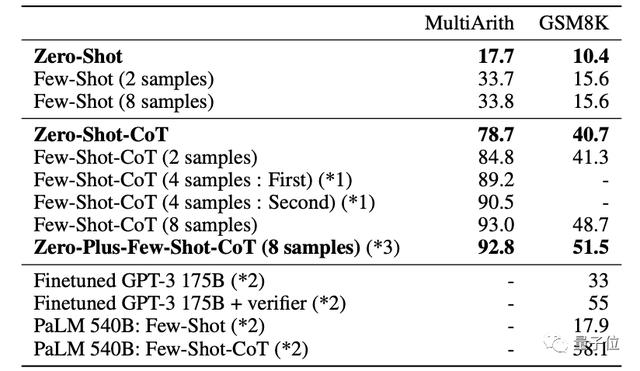

△右侧值为额外实验结果在比较有难度的MultiArith和GSM8K数学测试中,用GPT-3最新版本Text-davinci-002 (175B)做了更深入实验。

如果给8次尝试机会取最好结果,还能进一步提升准确率至93%。

论文的最后,研究团队提出这项研究不仅可以作为零样本CoT的基线,更希望让学界认识到在构建微调数据集和少样本提示模版之前,充分发掘语言大模型零样本能力的重要性。

研究团队来自东京大学松尾研究室。

负责人松尾丰教授,同时是软银董事会中的第一位人工智能专家。

团队成员中的客座教授顾世翔来自谷歌大脑团队,顾世翔本科师从三巨头之一Hinton,博士毕业于剑桥大学。

加点“魔法”已经成为AI圈新潮了

加点“魔法”已经成为AI圈新潮了零样本CoT究竟为何起作用还有待探索。

不过有人实验得出,这种办法似乎只对GPT-3(text-davinci-002)比较有效,他尝试了001版本,发现收效甚微。

他列出了一个自己做的例子。

提问:请将machine,learning中每个单词的最后一个字母连起来。

GPT-3在提示下给出的答案是连起来了两个单词中的所有字母。

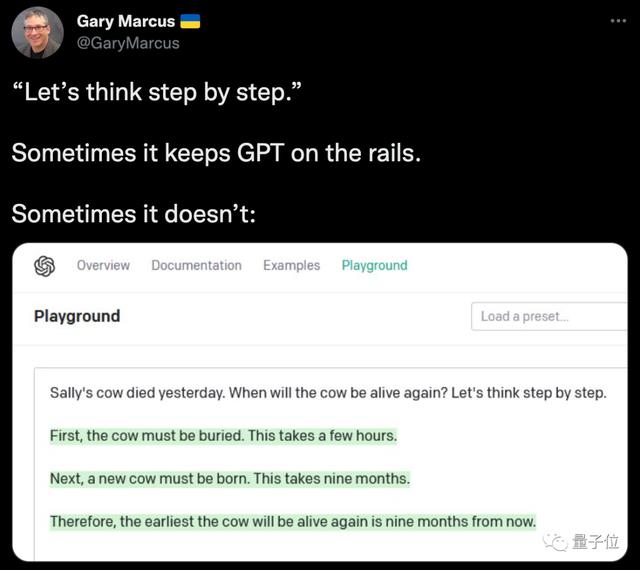

同时,我们在吐槽队伍里又看到了马库斯的身影。

他也列出了一个失败的例子,GPT-3在“咒语”加持下也没弄明白,莎莉的牛到底会不会起死回生……

包括引爆这次话题的推特博主Aran,正是当初发现加一句“虚幻引擎”就能让AI生成图像画质飞升的那位。

也有人表示,这种用在AI上的技巧,不正是自己平常动脑时会用的吗?

论文地址:https://arxiv.org/abs/2205.11916

参考链接:[1]https://twitter.com/arankomatsuzaki/status/1529278580189908993[2]https://evjang.com/2021/10/23/generalization.html

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

相关文章

猜你喜欢

成员 网址收录40386 企业收录2981 印章生成229557 电子证书1008 电子名片58 自媒体46096