编辑:Aeneas 好困

【新智元导读】这个全新发布的Lamini引擎,大大拉低了模型训练的门槛,开发者人手一个ChatGPT的梦想成真了。

快速定制模型的LLM引擎Lamini来了,开发者狂喜!

ChatGPT虽好,但始终有门槛。通常,只有拥有AI博士学位的大型机器学习团队,才能这样训练一个模型。

为了把这个门槛打下来, 团队构建了Lamini引擎,从此,每个开发者都能够拥有从GPT-3训练ChatGPT的超能力!

划重点:可以商用!可以商用!可以商用!

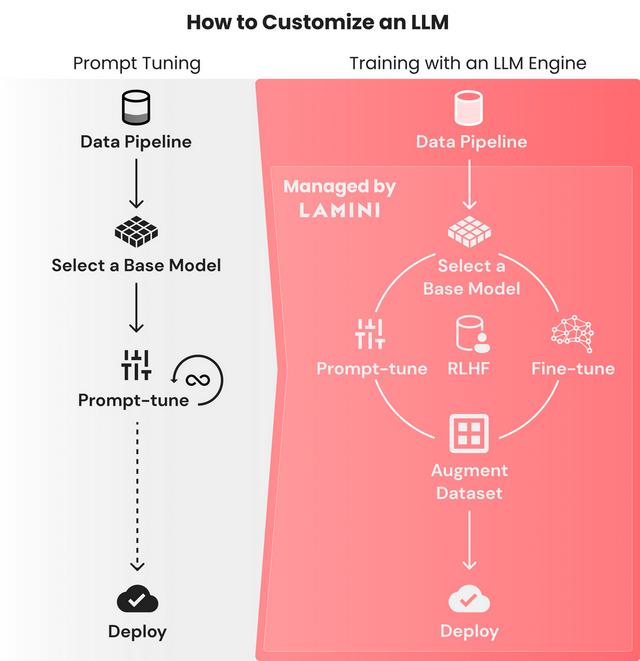

训LLM就像prompt-tuning一样简单

写一个prompt如此容易,但想要从基础模型训练出一个大语言模型,却是如此困难。

因为需要花费大量时间,来找出微调模型失败的原因,所以对数据集微调的迭代周期都是以月为单位的。

与之相反,微调prompt的迭代,只需要几秒钟,并且在几个小时内,性能都能保持稳定。

这个过程只需要把有限数量的数据整合到prompt中就可以了,并不需要动辄几TB的数据。

项目地址:https://github.com/lamini-ai/lamini/

在大型数据集上微调基础模型除了数据生成器,研究者还发布了一个LLM,它使用Lamini对生成的数据进行了微调。以编程方式执行此操作的功能也会很快发布。

也可以把OpenAI的微调API作为起步。

在微调模型上进行RLHF使用Lamini,就不再需要大型ML和人工标记团队来运行RLHF。

部署到云端只需点击产品或功能中的API端点即可。

专为LLM打造的数据生成器

简单来说,依照以下几个步骤,就可以训练自己的大语言模型了。

用于优化prompt微调和类型化输出(typed outputs )的 Lamini库。用于微调和RLHF的高级Lamini库,只需几行代码。史上首个托管数据生成器,用于创建数据,来训练遵循指令的LLM。注意,已获得商业使用许可!开源的指令跟随(instruction-following)LLM,使用上述工具,只需几行代码即可完成。数据生成器工作原理

Gregory Diamos是MLPerf的联合创始人。

他曾是百度硅谷AI实验室的创始成员,对DeepSpeech和DeepVoice系统有贡献。

参考资料:

相关文章

猜你喜欢