一觉醒来,万众期待的GPT-4,它来了!OpenAI老板Sam Altman直接开门见山地介绍说:

这是我们迄今为止功能最强大的模型!

甚至只需要简单在纸上画一个网站的草稿图:

不得不说,自打ChatGPT问世以来,微软和谷歌之间打响的数轮科技战役,微软这次又双叒叕赢麻了。

甚至这一次,不少网友都发出了“见证历史”的感慨:

那么GPT-4这些新能力实际用起来是什么样的?技术报告中也给出不少展示。

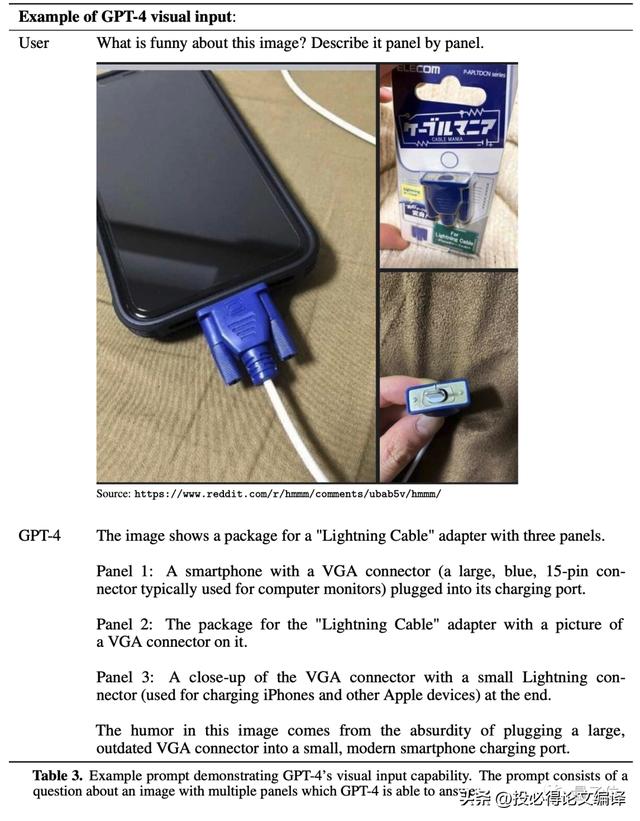

首先,看图能力可以用来解释表情包、梗图。

提问这张图哪里好笑?GPT-4可以按顺序描述出每一格的内容,并总结出笑点:

用巨大的过时VGA接口给小巧的现代智能手机充电。

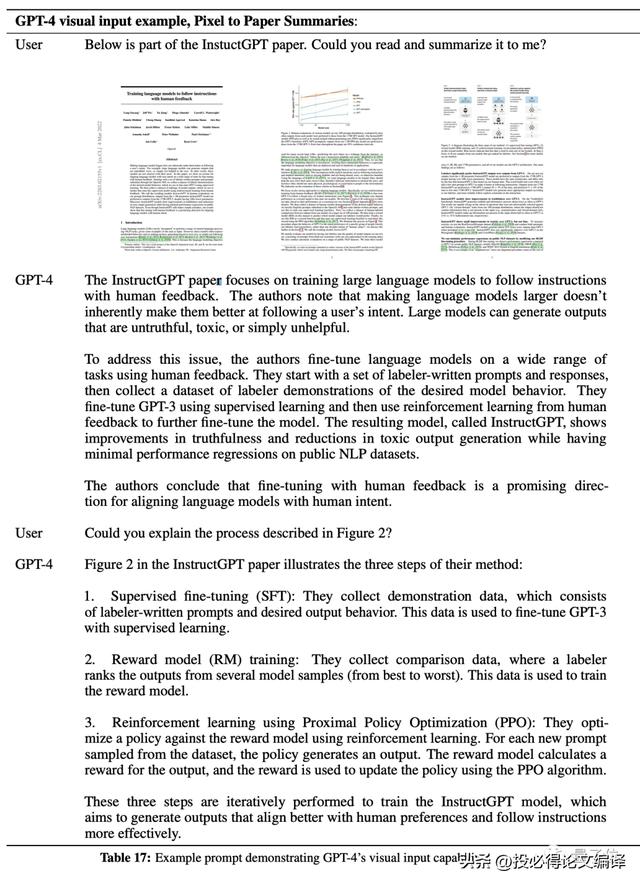

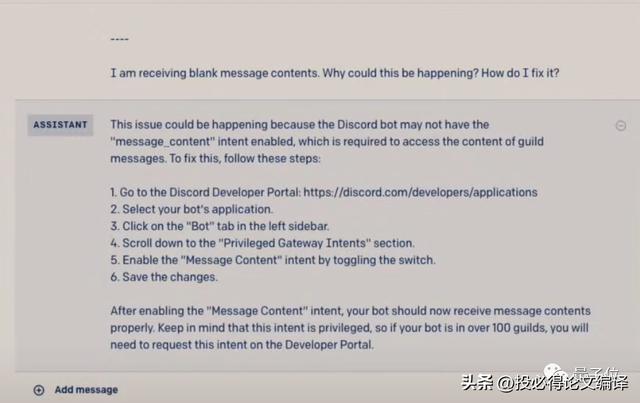

甚至可以直接把论文截图发给它,GPT-4可以按像素处理其中的文字和图片,并给出对整篇论文的总结摘要。

再最后附上出现的问题,在几秒钟内瞬间得到解决办法。

但不同于微软和OpenAI的“发布即可用”,谷歌只会先将Docs和Gmail中的AI工具,在月底提供给一些“值得信赖的开发人员”。

而其它功能则将是在今年晚些时候向公众开放。

至于具体时间,谷歌方面并没有具体说明。

而外界对此评价是谷歌希望抢先微软原定于本周四的发布。

但从今天的结果上来看,微软依旧提前“抢滩登陆”。

One More Thing

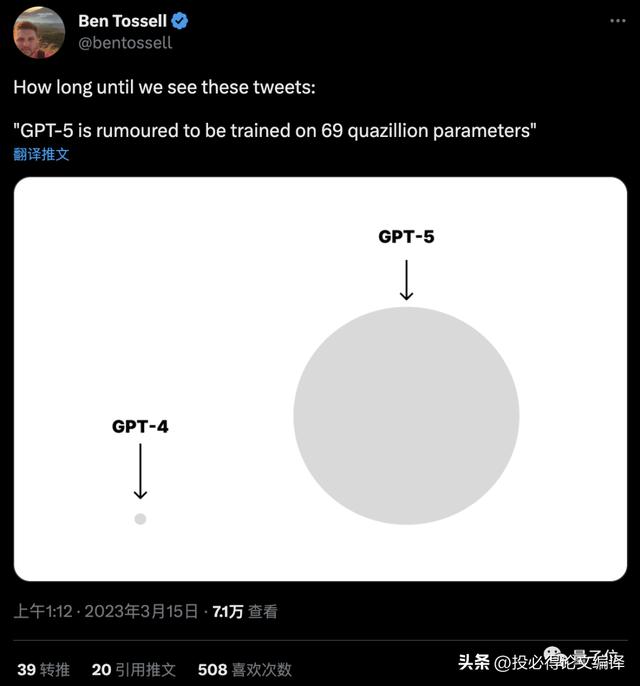

在GPT-4发布之前,便有网友做出了GPT-3和GPT-4参数量的对比图,并猜测GPT-4的参数量将达到100万亿。

这一次亦是如此。

有网友预言,未来GPT-5的参数量,会是这样的:

但无论如何,这一次,我们离真·人工智能,更近了一步。

参考链接:

[1] https://openai.com/research/gpt-4[2] https://blogs.bing.com/search/march_2023/Confirmed-the-new-Bing-runs-on-OpenAI’s-GPT-4[3] https://www.youtube.com/watch?v=outcGtbnMuQ

相关文章

猜你喜欢