2022年11月,由OpenAI开发的人工智慧聊天机器人程式ChatGPT横空出世,依据提问者所提出的要求,如求解数学方程式、文章写作、检视和整合程式码、语言翻译、文本摘要和关键字搜索、解释事情,其产生内容及文字精准度及博学程度,业界及学术界惊呼连连。

因ChatGPT掀起外界对AI的重视,专家同样担心AI的军事应用,今(2023)年2月中旬,美、中等五十个国家代表参加荷兰海牙峰会,虽主题在于讨论军用无人机以及杀手机器人等方面,其中美国国防部提出国际于AI军事应用合作。我国强调,要小心AI对战略的误判,避免造成衝突意外升级,有鑑于此,ChatGPT军事上应用之潜力与省思,将依据作战、训练、情报、后勤等方面进行分析,以及若使用ChatGPT须注意缺点与省思。

战场空间管制(Battle Spaces Autonomy)善用真实战场之传感器或类似其感知来源之资讯,训练ChatGPT针对命令管控等项,可达成以下成效:

1.命令管控:分析资讯,提供指挥官战场空间之决策改善、命令下达与管控。

2.规划协调:生成作战计划,并协调战场空间控制系统行动,以提升作战行动效率。

3.情蒐侦查:生成情蒐与侦查资讯,提升战场指挥官决断能力。

4.目标识别与追踪:有效识别与追踪战场空间目标,以提升战场空间控制准确率及有效性。

5.风险评估:针对战场空间不同行动进行风险评估,以确保部队安全。

后勤自驾车运载

后勤自驾车运载自驾车使用ChatGPT是否能有效运送补给品,取决于搜集资料准确性与数量;另外自驾车使用ChatGPT可能会引发安全性及可靠性等道德问题,若可解决,则可运用语音控制等项应用:

1.语音控制:可训练ChatGPT了解与反映语音命令,以利控制车辆导航、室内温度控制等功能。

2.文字语音转换:ChatGPT依据车用电脑生成文字转换成语音,以回应语音命令。

3.自然语言理解:训练ChatGPT了解自然语言输入,并转换成可操制之指令,使自驾车理解人类複杂之语言输入。

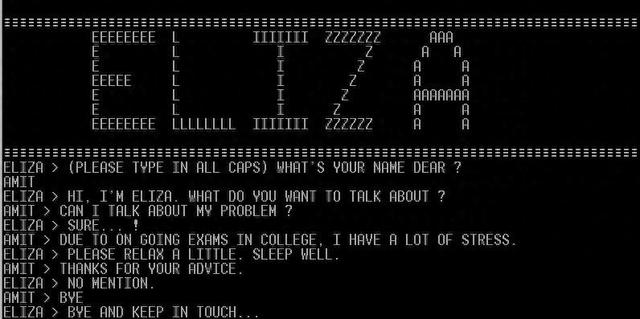

4.聊天机器人介面:ChatGPT藉由人类提问,提供有效资讯与建议,或遂行相关任务。

5.行驶前、中、后检查:可训练ChatGPT行驶前、中、后检查等资料,以确保车辆自我检查装备无虞。

应用ChatGPT作为军事用途的缺点与风险虽然ChatGPT可有效运用于军事相关作为,但仍有相关缺点仍须注意:

1.缺乏前后脉络的判断:ChatGPT可能无法理解战争起源或其背景,仅能用片断资讯,导致生成资讯不准确或产生不适切的回应。

2.偏见:若训练资料中有产生误差,可能会产生歧视性或冒犯性反应等问题。

3.资安问题:ChatGPT若落入敌方之中,会生成恶性钓鱼电子邮件与宣传。

4.对于数据依赖:ChatGPT生成资讯取决于其资料库的品质与数量,若无良好数据资料库,就无法产生精确数据与正确判断。

相关军事单位运用ChatGPT时必须先行省思,并制定相关使用指南与协议,确保使用时不会涉及下列问题:

1.虚假资讯:可能生成令人信服且複杂虚假资讯,会误导或欺骗敌人或盟军。

2.与论操控:可能生成影响舆论的资讯,可能会破坏民主或侵害个人或团体权益。

3.侵犯隐私:可能为了搜集情报侵犯个人或团体隐私。

4.自动武器:用于自动武器操控,若有不慎,可能伤害平民百姓。

5.缺乏问责:因ChatGPT未有人的意识,难以追究其行为责任,可能导致逃避责任等问题。

ChatGPT使用虽然可快速产生计画与决策,但现前会产生虚假资讯,造成决策误判。我们生而为人,必须自我累积知识,从实务学习技术与能力,内化经验成为养分,辅以ChatGPT相关资讯,才可精准判断,下达适切决策。

相关文章

猜你喜欢