图注:用于对大型语言模型和图灵论文进行评分的指标

图灵 1950 年的原始论文提出了用于图灵测试的 37 个问题,当中有针对他思考关于机器的中心主题,还有一些是向实验模仿游戏的计算机提出的示例问题。研究人员在 ChatGPT 的对话框中,将论文大纲中的主题混合在一起后摘录了这些问题,用来提示 ChatGPT 重现原始的基本内容。

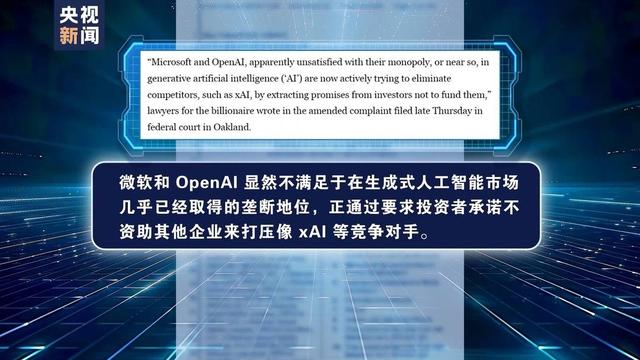

ChatGPT 完成内容的生成后,在可读性、正确性、清晰性等指标上与图灵的原始论文进行比较,结果如下图。

自2014年以来,作为对文本和图像生成的限制,高质量提示工程的使用已变得司空见惯,通常效果越好,关于样式、地点或时间的说明或限定词越详细。事实上,构建提示本身是当今 AI 中获得良好输出的最具创造性的方面。在这种情况下,人们可以通过使用 ChatGPT 强制进行创造性工作,同时处理单一主题、对所需输出的风格和基调的多层限制,将图灵和 Lovelace 测试交织在一起。

下面显示了 ChatGPT 在图灵模仿游戏中生成的十种诗歌:

图灵测试的结果由人类来裁决。正如 ChatGPT 所回答的,提问者是否判断模型通过了图灵测试问题“将取决于多种因素,例如机器提供的响应质量、提问者区分人和机器响应的能力,以及用于确定机器是否成功模仿人类的特定规则和标准。最终,游戏的结果将取决于具体情况和参与者。”

4 LLM 只做序列预测

并不真正理解语言

可以看到,当代基于 LLM 的对话互动可以创造一种令人信服的错觉,仿佛置身于我们面前的,是像人类这样会思考的生物。但就本质而言,此类系统从根本上不同于人类,像 ChatGPT 这样的 LLM 还涉及技术哲学的话题。

语言模型正变得越来越擅长模仿人类语言,这带来一种强烈的感受,即这些 AI 系统已经与人类非常相像,而且我们会使用“知道”、“相信”和“认为”等具有强烈自主意识的词语去描述这些系统。基于上述现状,DeepMind 资深科学家 Murray Shanahan 在近日一篇文章中提到,要破除任何或过度悲观或过度乐观的迷思,我们需要清楚 LLM 的系统到底是如何运作的。

Murray Shanahan

1、LLM 是什么,可以做什么?BERT、GPT-2 等 LLM 的出现改变了人工智能的游戏规则,之后的 GPT-3、Gopher、PaLM 等大模型基于 Tansformer 架构,在数百 TB 的文本数据上进行训练,更加凸显了数据的强大作用。

这些模型的能力是令人惊讶的。首先,它们在基准上的表现与训练集的大小成比例;其次,随着模型规模的扩大,它们的能力有了质的飞跃;最后,许多需要人类智能的任务可以简化为使用性能足够的模型“对下一个token进行预测”。

最后一点实际上揭示了语言模型的运作方式与人类的根本不同。人类在相互交流中所使用的的直觉是经过数千年进化而来的,如今人们正在错误地把这些直觉迁移到 AI 系统上。ChatGPT 具有相当大的实用性和巨大的商业潜力,为了确保它能被可信地、安全地部署,我们需要了解它的实际工作原理。

与人类语言相比,大型语言模型有什么本质上的不同?

如维特根斯坦所说,人类语言的使用是人类集体行为的一个方面,它只有在人类社会活动的大背景下才具有意义。人类婴儿是出生在一个与其他语言使用者共享的世界,并通过与外部互动来习得语言。

而 LLM 的语言能力来源不同。人类生成的文本构成一个大规模的公共语料库,它包含了单词、单词的构件、或带标点的单个字符等 tokens,大型语言模型就是关于这些 tokens 的统计分布的生成式数学模型。

所谓的“生成”,是指我们可以从这些模型中取样,也就是进行提问。但提问的问题是非常具体的,比如我们要求 ChatGPT 帮我们续写一段话,实际上是在要求它根据它的人类语言统计模型,来预测接下来可能会出现什么词。假如我们给 ChatGPT 提示“第一个在月球上行走的人是”,并假设它会回答“Neil Armstrong”。这里实际上并不是真的在问谁是第一个在月球上行走的人,而是:给定大量文本公共语料库中单词的统计分布,哪些单词最有可能遵循“第一个在月球上行走的人是”的序列?

尽管模型对这些问题给出的答案可能会被人类解读为模型“理解”了语言,但实际上对模型而言,它要做的就是生成具有在统计上可能的单词序列。

2、LLM 真的什么都懂吗?LLM 通过以下两个方式来转变为问答系统:

a) 将其嵌入到更大的系统中;

b) 使用 prompt 工程来引发所需的行为。

这样一来,LLM 不仅可以用于问答,还可以用来总结新闻文章、生成剧本、解决逻辑难题以及进行语言翻译等。

这里有两个重要的要点。首先,LLM 的基本功能即生成统计意义上可能的单词序列,是非常通用的。其次,尽管具有这种多功能性,但所有这类应用程序的核心都是同一种模型,都只做同一件事,即生成统计意义上可能的单词序列。

LLM 的基础模型包括模型架构和训练参数。一个 LLM 并不真正“知道”任何事情,因为它所做的一切在底层意义上都是序列预测。模型本身并没有“真”或“假”的概念,因为它们不具备人类运用这些概念的方法。LLM 在某种意义上并不依赖意图立场。

这对于以 LLM 为核心的对话系统也是一样,它们并不能理解人类语言中关于真理的概念,因为它们不存在于我们人类语言使用者所共享的世界中。

3、关于涌现如今的 LLM 是如此强大、多才多艺,以至于人们很难不或多或少地赋予其人格。一个相当具有吸引力的论点是,尽管 LLM 从根本上说只执行序列预测,但在学习这样做的过程中,它们有可能发现了需要用更高层次的术语比如“知识” 和“信念”进行描述的涌现机制。

事实上,人工神经网络可以将任何可计算函数逼近到任意精度。因此,无论需要何种机制来形成信念,它们都可能驻留在参数空间的某个地方。如果随机梯度下降是优化准确序列预测目标的最佳方式,那么给定一个足够大的模型、足够多的正确类型的数据以及足够的算力来训练模型,也许它们真的可以发现那种机制。

而且,最近的 LLM 研究进展已经表明,当足够大的模型在非常大量的文本数据上进行训练时,就会涌现出非凡的、意想不到的能力。

然而,只要我们的考虑仅限于一个简单的基于 LLM 的问答系统,它就根本不涉及交际依图。不管它使用的内部机制是什么,序列预测本身并没有交际意图的,简单地将交际依图嵌入到对话管理系统中也无济于事。

只有在能够区分真假的情况下,我们才能谈论最完整意义上的“信念”,但是 LLM 并不负责做出判断,它只是模拟哪些词可能跟在其他词后面。我们可以说 LLM“编码”、“存储”或“包含”知识,也可以合理地称 LLM 的一个涌现属性是它编码了日常生活世界的各种知识及其工作方式,但如果说“ChatGPT 知道北京是中国的首都”,那便只是一种修辞。

4、外部信息来源这里的重点是,涉及将任何信念完全归于一个系统的先决条件。

任何东西都不能算作对我们共享的世界的信念,从广义上讲,除非它是在根据来自某个世界的证据适当地更新信念的能力的背景下,这是辨别真假能力的一个重要方面。

维基百科或其他一些网站,能否提供外部标准来衡量一个信念的真实性或虚假性?假设一个 LLM 被嵌入到一个系统中,该系统定期咨询此类资源,并使用现代模型编辑技术来保持其预测的事实准确性,实现信念更新需要什么样的能力?

序列预测器本身可能不是那种可以具有交流意图或形成对外部现实的信念的事物。但是,正如反复强调的那样,野外的 LLM 必须嵌入到更大的体系结构中才能发挥作用。

要构建一个问答系统,LLM 只需辅以一个对话管理系统以适当地查询模型。这个更大的架构所做的任何事情都可以算作交流意图或形成信念的能力。

至关重要的是,这种思路取决于从语言模型本身到语言模型所属的更大系统的转变。语言模型本身仍然只是一个序列预测器,并没有像以往那样更多地访问外部世界。只有相对于整个系统,在这种情况下,意向性立场才会变得更有说服力。但在屈服于它之前,我们应该提醒自己,这样的系统与人类有多么不同。

5、视觉-语言模型LLM 可以与其他类型的模型结合和/或嵌入到更复杂的体系结构中。例如,VilBERT 和 Flamingo 等视觉语言模型 (VLM) 将语言模型与图像编码器相结合,并在文本-图像对的多模态语料库上进行训练。这使得它们能够预测给定的单词序列将如何在给定图像的上下文中继续。VLM 可用于视觉问答或就用户提供的图像进行对话,也就是俗称的“看图说话”

那么,用户提供的图像能否代表可以评估命题真假的外部现实?谈论 LLM 的信念是否合理?我们可以想象,一个 VLM 使用 LLM 来生成关于图像的假设,然后针对该图像验证其真实性,然后对 LLM 进行微调,以免做出被证明是错误的陈述。

但大多数基于 VLM 的系统并不是这样工作的。相反,它们依赖于文本和图像联合分布的冻结模型。用户提供的图像与 VLM 生成的文字之间的关系,与人类共享的世界与我们谈论该世界时使用的文字之间的关系根本不同。重要的是,前者仅仅是相关关系,而后者则是因果关系,当然,模型在推理过程中进行的计算存在因果结构,但这跟词语与其所指事物之间的因果关系不同。

6、具身 AI人类语言使用者存在于一个共享世界中,这使得我们与 LLM 有着本质区别。孤立的 LLM 无法通过与外界交流来更新自己的信念,但如果将 LLM 嵌入到更大的系统中会如何呢?比如,呈现为机器人或虚拟化身的系统。这时候谈论 LLM 的知识和信念是合理的吗?

这要取决于 LLM 是如何具身化的。

以今年谷歌发布的 SayCan 系统为例,在这项工作中,LLM 被嵌入到控制物理机器人的系统中。机器人根

据用户的高级自然语言指令执行日常任务(例如清理洒在桌面上的水)。

其中,LLM 的工作是将用户的指令映射到将帮助机器人实现所需目标的低级动作(例如寻找海绵)。这是通过一个工程化的 prompt 前缀来完成的,该前缀使模型输出合适的低级动作的自然语言描述,并对它们的有用性进行评分。

SayCan 系统的语言模型组件可能会无视机器人所在的实际环境来给出动作建议,比如旁边并没有海绵。所以,研究人员使用一个单独的感知模块利用机器人的传感器来评估场景,并确定执行每个低级动作的当前可行性。将 LLM 对每个动作的有用性评估与感知模块对每个动作的可行性评估结合起来,便可以得出下一步最优动作。

尽管 SayCan 在物理上有与现实世界的互动,但它学习和使用语言的方式与人类仍然非常不同。SayCan 这类系统中包含的语言模型经过预训练,可以在纯文本数据集的无实体环境中执行序列预测。它们并没有通过与其他语言使用者交谈来学习语言。

SayCan 的确给我们带来了关于未来语言使用系统的一种想象,但在今天这样的系统中,语言的作用非常有限。用户用自然语言向系统发出指令,系统生成对其动作的可解释的自然语言描述。但是,这种微小的语言使用范围根本无法与由语言⽀持的人类集体活动的规模相提并论。

所以,即使是对于包含 LLM 的具身 AI 系统,我们也要谨慎地选择词语去描述它们。

7、 LLM 能够推理吗?现在我们可以否认 ChatGPT 具有信念,但它真的可以推理(reason)吗?

这个问题更加棘手,因为在形式逻辑中,推理是内容中立的(content neutral)。比如无论前提如何,“肯定前件”(modus ponens)的推理规则都是有效的:

如果:所有的人都会死,苏格拉底是人;那么:苏格拉底会死。

逻辑的内容中立性似乎意味着我们不能在推理方面对 LLM 过多苛求,因为 LLM 无法杰出到可以衡量真假的外部现实。但即便如此,当我们提示 ChatGPT“所有的人都会死,苏格拉底是人,那么”时,我们并不是在让模型进行假言推理,而是在问:给定的公共语料库中的词语统计分布,哪些词可能遵循“所有的人都会死,苏格拉底是人,那么”这一序列。

而且,更复杂的推理问题会包含多个推理步骤,由于聪明的提示工程,LLM 可以有效地应用于多步推理,无需进一步培训。例如,在思维链提示中,在用户查询之前向模型提交一个提示前缀,其中包含一些多步骤推理的示例,并明确说明,所有中间步骤在思维链风格中都包含一个提示前缀会鼓励模型,以相同的风格生成后续序列,也就是说,包括一系列导致最终答案的显式推理步骤。

像往常一样,真正向模型提出的问题的形式是“给定公共语料库中单词的统计分布,哪些单词可能遵循序列 S ”,在这种情况下,序列 S 是链接 thought 提示前缀加上用户的查询,最有可能跟在 S 之后的标记序列,将具有与提示前缀中找到的序列类似的形式,也即是在它们当中,将包括多个推理步骤,因此这些就是模型生成的。

值得注意的是,不仅模型的响应采用多步骤论证的形式,而且所讨论的论证通常(但并非总是)有效,并且最终答案通常(但并非总是)正确。在某种程度上,适当提示的 LLM 似乎推理正确,它通过在其训练集中和/或提示中模仿格式正确的参数来实现。

但是,这种模仿能构成真正的推理吗?即使今天的模型偶尔会犯错误,是否可以进一步缩小这些错误,使模型的性能与硬编码推理算法的性能无法区分?

或许答案确实为“是”,但是我们怎么知道呢?我们怎么能相信这样的模型呢?

定理证明器生成的句子序列是忠实于逻辑的,因为它们是底层计算过程的结果,其因果结构反映了定理的推理结构问题。使用 LLM 构建可信推理系统的一种方法是将其嵌入到执行相同因果结构的算法中。但是,如果我们坚持使用纯 LLM,那么,要完全相信它产生的论点,唯一方法就是对其进行逆向工程,并发现符合忠实推理规定的紧急机制。与此同时,我们应该更加谨慎,并在描述这些模型的作用时慎重行事。

参考链接:

1.https://arxiv.org/ftp/arxiv/papers/2212/2212.06721.pdf

2.https://arxiv.org/pdf/2212.03551v1.pdf

未经「AI科技评论」授权,严禁以任何方式在网页、论坛、社区进行转载!

公众号转载请先在「AI科技评论」后台留言取得授权,转载时需标注来源并插入本公众号名片。

相关文章

猜你喜欢

成员 网址收录40394 企业收录2981 印章生成235016 电子证书1037 电子名片60 自媒体46963