近日,越来越多人表示自己的ChatGPT账户被封,各大平台、群聊都有人奔走相告“注意事项”以防被封。此时,原本尚可以使用的 Plus 账户也没有幸免,陆陆续续失效,甚至有些在账单里都无法查询记录。不少网友还在社交平台上发帖称,“ChatGPT 正在大面积封号了”。

用户聊条记录泄露事件后,虽然 OpenAI 非常爽快的向媒体承认 ChatGPT 出现了安全漏洞,并立刻下线聊天历史功能,但一直强调发生泄漏的只有聊天历史记录标题,用户无法看到其他人的实际聊天内容。

从 OpenAI 披露的信息来看,用户对话内容会自动保存到云端,存在被第三方窃取的可能性,结合此次历史聊条记录泄露事件,越来越多的安全研究人员开始认真思考 ChatGPT 出现信息安全问题是否具有偶然性。

多次导致机密数据泄漏

韩国媒体披露科技巨头三星电子在引入 ChatGPT 不到 20 天就被曝出 3 起内部机密资料外泄事故。(2 起跟半导体设备有关,1 起跟内部会议内容有关)。

据悉,这些三星电子的机密资料可能已经被导入到 ChatGPT 的数据库中,随时都面临泄露的风险。

员工在 ChatGPT 上传企业机密数据并非只有三星一家公司。从 Cyberhaven 统计的 160 万名员工使用 ChatGPT 的情况来看,约有 3.1% 的员工为提高工作效率,将企业内部数据直接上传到 ChatGPT 进行分析。

多名专家联名呼吁暂停更强AI的研究

从上文提到的内容可以看出,ChatGPT 应用广泛的同时带来一些严重安全风险。

甚至在前不久,比利时男子和一名为“Eliza”的聊天机器人聊天后自杀身亡。虽然Eliza和ChatGPT不太一样,Eliza基于由EleutherAI开发的GPT-J模型,两者大体相似,但有一点区别:GPT-J训练AI朝着更情绪化、更有趣和更有吸引力的方向优化。

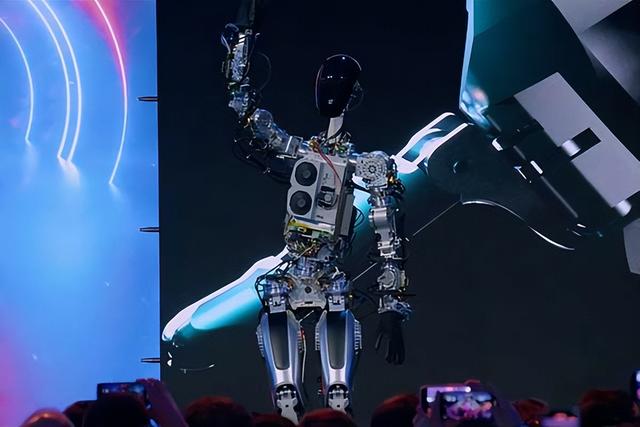

足以见得,有关 ChatGPT 和人工智能的未来,引起了民众对 AI 技术的担忧,许多知名科学人士联合声明暂停开发更强大的 AI 系统。

美国时间 3 月 29 日,包括人工智能之父杰弗里·辛顿、特斯拉和推特 CEO 埃隆·马斯克、图灵奖得主约书亚·本希奥等在内的上千名人工智能专家和行业高管在美国非营利组织未来生命研究所(Future of Life Institute)发布的一封名为“暂停 AI 大模型实验”的公开信上签署了姓名。

这些资深专家们在信中呼吁所有人工智能实验室应当至少暂停半年对更强大人工智能系统的开发和训练,特殊情况下,各国政府应及时介入并立刻暂停 AI 系统研究。

我们应当意识到,正如联名信中提到的:人工智能的研究和开发应该重新聚焦于,使目前最先进和强大的系统更加准确、安全、可解释、透明、稳健、一致、值得信赖和忠诚。

现在,我们成功地创建了强大的人工智能系统,可以在这个“人工智能之夏”中获得回报,为所有人的明确利益设计这些系统,并给社会一个适应的机会。停止使用其他技术可能会对社会造成灾难性影响,因此我们必须保持准备状态。让我们享受一个漫长的人工智能夏天,而不是匆忙进入秋天。

源于“安全保密”

相关文章

猜你喜欢