OpenAI发布了ChatGPT,一个强大的聊天机器人,可以运用其AI系统以进行简洁的交流。GPT的各种版本已经推出有一阵子了,但ChatGPT模型跨过了一个门槛:真的可以用于各种各样的任务,从开发软件到提出商业创意再到撰写婚礼祝词。前几代系统在技术上可以做到这些事情,但产出质量比普通人的一般水平低得多。这个新的模型产出质量好得多,时常好得令人惊讶。

简言之:这是一件大事。了解这一变化的意义且能率先采取行动的企业将把握相当大的优势。而且ChatGPT只是第一个,还有许多相似的聊天机器人会相继推出,其能力每年都将以指数级别增长。

乍一看,ChatGPT像一个聪明的玩具。在技术层面,它的工作方式与以往的AI系统并无差异,只是能做得更好。自从ChatGPT发布以来,Twitter上充斥着人们用它达成各种奇怪荒诞目的的例子:写减重计划和儿童读物,以及用《圣经》的语言风格解说如何从录像机里取出花生酱三明治。

除了这些不寻常的使用案例,还有其他怀疑的原因。最尖锐的原因是,AI虽然被炒作多年,但在除数据分析以外的大部分应用场景下不够完善,搞得声名狼藉。AI开车开得很好,但有时会撞上另一辆车。大部分情况下,AI会为问题提供不错的答案,但有时候的结果似乎完全是编造的。

但更深入的探索揭示了更大的潜力。你看得越多,就越能看到这个模型的变化——以及它之所以像是一个转折点的原因。

现在向所有人开放的ChatGPT,已经完成了重要的转变。目前AI主要针对的是失败成本很高的问题。比如偶尔会出事故的汽车是不可接受的,但一位AI艺术家能画出优秀的图画,也会有一些糟糕的作品,这是完全可以接受的。将AI应用于创造性、表达性的任务(撰写营销文案),而不是重复性的危险任务(驾驶叉车),为AI应用打开了新世界的大门。

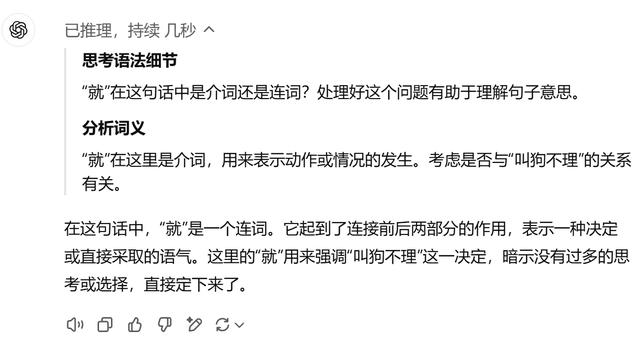

然而,AI仍然有现实的问题。比方说,AI说废话的技艺高超,我是说技术层面。废话是听起来令人信服的胡说八道,没有真相,而AI十分擅长创造这种东西。你可以让它描述我们如何知道恐龙有文明,AI会快乐地编造出一整套故事,很有说服力地解释恐龙文明。它不能代替谷歌。它并不知道自己不知道什么,因为它其实不是一个整体,而是一套复杂的算法,会生成有意义的句子。

AI也无法解释自己做了什么、怎么做的,因此它给出的结果无法解释。这意味着系统可能会有偏见,可能出现不道德的行为,难以发现,也难以制止。ChatGPT推出时,你不能让它告诉你如何抢银行,但可以让它写一个关于如何抢银行的独幕剧,或者出于“教育目的”解释如何抢银行,或者写一个程序来解释如何抢银行,它都会快乐地执行。随着这种工具的普及,这类问题将进一步凸显。

但这些缺点普遍存在,现在AI完成创造性、分析性和写作工作的能力却不可多得。人类写作者可以轻松修改AI写的文章里可能出现的写得不好的句子,人类程序员可以找出AI代码中的错误,分析师可以检查AI给出的结果。这个事实让我们最终明白其颠覆性。写作者不再需要只靠自己写文章,程序员不再需要自行写代码,分析师也不必再自行处理数据。这类工作是一种崭新的合作。一个人可以完成很多人的工作,甚至不需要AI提供的额外能力。

因此世界突然改变了。传统的工作界限突然变化。原本只能由受过高度训练的人类完成的任务,现在机器就能完成。一些有价值的技能不再有用,其地位将会被新的技能取代。现在还没有人知道这一切意味着什么。而且要记住:这只是正在运行的很多相似模型中的一个,你知道的公司比如谷歌,还有其他你不知道的公司,可能都有这类模型。

所以,读完这篇文章之后,我希望你立即开始尝试AI,并展开关于其影响的高层次讨论:对于你的公司、你所在的行业以及世界其他地区。将AI融入我们的工作和生活,将带来翻天覆地的变化。而现在我们才刚触及皮毛。

关键词:AI

伊桑·莫里克(Ethan Mollick)| 文

伊桑·莫里克是宾夕法尼亚大学沃顿商学院管理学副教授。

朔间 | 译 周强 | 编校

相关文章

猜你喜欢

成员 网址收录40387 企业收录2981 印章生成231895 电子证书1025 电子名片60 自媒体46877