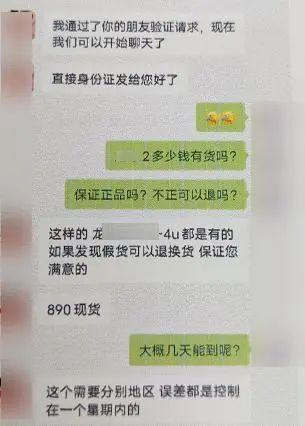

不久前,一篇《警惕!AI诈骗正在全国爆发,有公司老板10分钟内被骗430万元》的视频在网上传播,内容是包头警方发布了一起利用人工智能实施电信诈骗的典型案例。4月20日中午,福州市某科技公司法人代表郭先生的好友突然通过微信视频联系他,称自己的朋友在外地竞标,需要430万元保证金且需公对公账户过账,想要借郭先生公司的账户走账。基于对好友的信任,加上已经视频聊天核实了身份,郭先生没有核实钱款是否到账,就分两笔把430万元转到了好友朋友的银行卡上。后郭先生拨打好友电话才知道被骗。骗子通过智能AI换脸和拟声技术佯装好友对他实施了诈骗。骗子直接用好友微信发起视频聊天,这是郭先生被骗的原因之一。

篡改后台程序算法,易引发涉计算机类犯罪。高曼洁表示,“山寨版”ChatGPT生成虚假链接,引诱对话人点击,可能发生恶意攻击电脑设备、侵入特定领域的计算机信息系统、非法获取相关数据等行为,涉嫌非法侵入计算机信息系统罪、破坏计算机信息系统数据罪等。如网络黑客入侵AIGC类应用后台,篡改信息生成算法和检索内容,定向修改某类检索内容结果,易误导网民,或造成流瀑效应,破坏网络公共秩序。

海量内容精准搜索,易引发传播淫秽色情、传授犯罪方法类犯罪。高曼洁说,AIGC类应用依靠抓取海量信息数据,通过深度学习算法生成检索内容,对用户进行特定内容搜索,容易获取淫秽色情、犯罪方法、宣扬暴力甚至恐怖组织等信息,若某些网站专门提供上述信息的AIGC检索服务,将提高犯罪方法信息精确度,增大相关违法犯罪行为发生的风险。

生成内容可靠性存疑,易引发侵害人格权类犯罪。ChatGPT等AIGC类应用是对海量互联网信息的加工整合,信息真伪不明、道德边界感模糊。互联网上发布的娱乐八卦、网评等可能涉及个人隐私的信息,均可作为AIGC类应用的整合资源,且生成内容以“检索结果”展示,易让用户误以为是“标准答案”,则可能涉嫌侮辱、诽谤、侵犯公民个人信息等侵害人格权类犯罪。

规范前端,从源头降低AIGC刑事法律风险生成式人工智能承担了信息收集者、信息加工者两个角色,最终成为服务提供者。因此,高曼洁认为,把控好前端服务提供者的行为责任,能够从源头上降低生成式人工智能的刑事法律风险。

内容提供者首先要确保可信信息源,从数据安全、个人信息保护、知识产权等方面,保证信息来源合法合规。

此外,还要对生成内容负责。生成式人工智能与传统的搜索引擎不同,不是简单的链接提供者,而是在现有信息基础上,经过算法加工而成的内容。因此,提供生成式人工智能产品或服务应当做到防止歧视、公平竞争、防止形成虚假信息、禁止非法获取个人信息和商业秘密等。也就是说,提供者需要对最终生成的内容承担符合道德、法律的义务。在生成内容责任方面,《意见稿》特别提出了对人工标注的规范,即“生成式人工智能产品研制中采用人工标注时,提供者应当制定符合本办法要求,清晰、具体、可操作的标注规则,对标注人员进行必要培训,抽样核验标注内容的正确性。”高曼洁称,从标注的人员到标注的内容进行规范,是对算法生成中重要的人工参与步骤进行合理引导,从而提高生成内容的合法合规性。

“另外,还需要承担流程报备责任,主要包括申报安全评估、前置算法备案等备案义务。”《意见稿》规定,“利用生成式人工智能产品向公众提供服务前,应当按照《具有舆论属性或社会动员能力的互联网信息服务安全评估规定》向国家网信部门申报安全评估,并按照《互联网信息服务算法推荐管理规定》履行算法备案和变更、注销备案手续。”高曼洁说,通过报备的方式,使生成式人工智能置于主管部门的管理之下,便于在发生违法违规行为时及时处置。

加快立法,加大新兴技术监管力度

加快立法,加大新兴技术监管力度生成式人工智能技术在科技领域具有颠覆性,法律显而易见存在滞后性,目前,如何防范AIGC可能引起的刑事风险,以期科技能更好更稳地促进社会发展?

印波建议:

一是尽快进行规范,实施包容审慎监管。国家网信办发布的《意见稿》应当尽快在社会上形成共识,从而最大限度地控制生成式人工智能带来的风险。生成式人工智能的提供者及使用者要建立好合规机制,一旦出现相应的风险,需要自查自纠进行整改,在审慎探索中创新应用。

二是积极与国际社会形成共识,积极探讨生成式人工智能的跨境运用。譬如,美国已经开始审查是否需要对人工智能技术进行监管。美国商务部于当地时间2023年4月11日发布了一份正式的公开意见征求文件,征求内容包括政府是否应该在可能具有潜在风险的人工智能模型发布之前对之进行批准。我们应当积极与美国展开对话,以期达成共识。

三是应当要求生成式人工智能提供者承担信息源责任、生成内容责任、流程报备责任,确保信息来源合法合规,生成内容真实可靠且有据可查。

高曼洁建议:

加大普法宣传力度,增强网民反诈意识。引导网民合法合规使用合法软件,准确识别被伪装的山寨链接,避免泄露个人信息。而法律工作者需要做好风险预判和普法宣传,让民众的风险意识与科技创新同步并行。

加快新技术规范立法工作。探索算法推荐等技术管理制度的落地路径,明确自动生成内容类应用检索信息的边界,提高应用开发和应用算法的透明度,确保生成式人工智能应用开发和推广以安全、道德、尊重公民权利和隐私的方式规范开展。

完善救济途径。可在AI发布后,以提供补丁网站的方式,便利相关权利人提交不予授权的声明,及时删除不予授权的信息源,以避免和解决AI使用过程中的权属争议。

虽然生成式人工智能在科技领域具有颠覆性,但在世界范围内应用时间毕竟不长,高曼洁认为,需要对其应用过程中产生的风险进行有效的法律评估,这样才能让科技在正确的轨道上为人类所用。

原文刊登于2023年6月20日《人民政协报》第12版

记者:徐艳红

相关文章

猜你喜欢