OpenAI最近对其聊天语言模型ChatGPT进行了一次更新,这引发了人们对该更新是否对我们隐私具有更友好特性的关注。随着人工智能的发展,保护个人信息和隐私成为使用者越来越关心的问题。本文将探讨OpenAI的最新更新是否能够提供更加友好的隐私保护功能。

OpenAI最近对ChatGPT进行了一次更新的迹象引起了我们的关注。根据Reddit我们"kocham_psy"的报道,他在ChatGPT的源代码中发现了新版本的界面。他声称通过使用脚本欺骗网站,他提前一周就发现了即将正式发布的聊天分享功能。

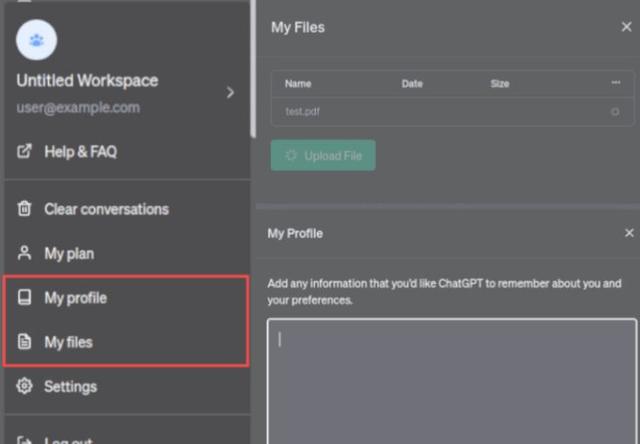

泄露的屏幕截图显示了一个名为"工作区"的新功能,我们可以在其中输入ChatGPT应记住的默认信息,并具备上传文件的能力。这可能是OpenAI宣布的ChatGPT商业版本的早期形式。

OpenAI承诺在2023年4月底推出这个变体,作为即将发布的新隐私措施的一部分。ChatGPT商业版本被设计为更加注重我们隐私, 默认情况下不再使用我们数据进行模型训练。然而,与专业版不同的是,聊天记录将会被保留。

尽管OpenAI尚未透露有关商业版的详细信息,但截图显示商业版可能允许我们与同事共享不同的工作空间,即工作组。"Profile"区域可以预先设置ChatGPT,类似于GPT-4API的系统提示。

举例来说,我们可以设定自己的工作角色(如"社交媒体经理"、"编辑"等),这样就不必在每次聊天中都反复提及。当然,ChatGPT默认会尊重我们的某些样式偏好。

文件上传功能可用于使文档与聊天产生关联,例如生成摘要或搜索信息。微软还计划在自己的服务器上运行商业版的ChatGPT,但据报道其成本是普通版本的十倍。

这些新变化为ChatGPT带来了更多功能和隐私保护的承诺。然而,更多关于商业版的细节仍然待揭示。我们对OpenAI在推出商业版时如何确保数据安全和隐私保护的担忧仍然存在。我们期待未来几周内获取更多关于该版本的详细信息,并评估其对体验和隐私权的影响。

在人工智能技术不断演进的同时,隐私保护也成为一个迫切的问题。OpenAI的ChatGPT更新标志着公司对隐私的重视,并承诺通过商业版本来提供更友好的隐私保护特性。然而,我们需要密切关注其具体实施细节以及对数据和聊天记录的处理方式。只有在建立严格的隐私保护准则和监管机制的前提下,才能确保人工智能技术的发展与隐私的合理平衡,为我们提供安全可靠的使用体验。

相关文章

猜你喜欢

成员 网址收录40406 企业收录2983 印章生成241015 电子证书1067 电子名片60 自媒体64547