2022年11月中国互联网络信息中心发布的《2021年全国未成年人互联网使用情况研究报告》显示,我国未成年网民规模为1.91亿,未成年人互联网普及率达96.8%。其中,上网聊天作为未成年人主要的网上沟通社交活动,占比达到53.4%。

暑期正值未成年人上网高峰期,面对这一庞大的网民群体,网络社交平台是否做好了充足的准备?

为此,南都记者参考App累计下载量,随机选取头部、中部、尾部共12款网络社交类App进行实测。本次测评考察重点在于平台是否建立相应机制识别未成年用户,是否建立健全青少年模式,以及平台内容生态治理情况。

实测发现,大多数被测App设置的适用年龄门槛形同虚设,用户任意填写18周岁及以上年龄,即可绕过App年龄验证环节。在“青少年模式”逐渐成为App“标配”的当下,仍有4款App没有建立这一模式,其中还包括在应用市场下载量排名靠前的头部App。

此外,多款被测App均存在淫秽色情、低俗庸俗以及“擦边”内容等负面有害信息。比如一些推送的图片或视频中,画面纷纷对准女性胸部或下体;还有一些主播在直播跳舞时不断向镜头突出展示胸部和臀部,打起了色情“擦边球”。

身份识别

用户出生日期随便填,“强制”已满十八周岁

南都记者参考“七麦数据”榜单,根据华为应用商店App累计下载量随机选取头部(下载次数约10亿-20亿)、中部(下载次数约1亿-5亿)、尾部(下载次数约千万级别)一共12款主打网络社交功能的App进行实测,测试时间为6月9日至7月20日。

“最右”青少年模式开启弹窗

但也有不少被测App在注册完成后不会出现上述弹窗,其通常将该模式的开启选项设在“设置”页面中,需由用户主动寻找并点击。另外,“探探”“百度贴吧”“绿洲”“青藤之恋”4款App没有青少年保护模式。

当南都记者使用未成年人的姓名和身份证号完成部分被测App提供的强实名认证时,“TT语音”会自动触发青少年模式且不可绕过,且由于用户经实名认证已被确认为未成年人,无法再关闭青少年模式。

不过,由于“MOMO陌陌”“Soul”预先默认用户为成年人,因此在识别未成年人时均采取“身份证号码 人脸信息”强实名认证。实践中,这一设置是否会增加未成年人主动认证和平台识别的难度,以及收集未成年人这一需要强保护群体的人脸信息,是否涉嫌过度收集个人信息等问题也值得重视,因此,在此使用强实名手段值得商榷。

在8款设有青少年模式的App中,有2款App在开启该模式后,被禁用一切功能,用户无法进行任何操作。比如开启“带带陪玩”青少年模式后,出现弹窗提醒用户“您将无法使用核心功能”,页面停留在弹窗页面无法关闭,用户只能选择“关闭青少年模式”或者退出App。

“带带陪玩”语音区提示有诱导消费之嫌

平台审核和投诉机制

多数被测App“不忌烟酒”,仅两款迅速删除不良照片

考虑到UGC(用户原创内容)是网络社交App重要的内容来源,过滤负面信息应该是平台内容治理的第一道防线。

《未成年人保护法》规定,网络服务提供者发现未成年人通过网络发布私密信息的,应当及时提示,并采取必要的保护措施。及时过滤涉及未成年人私密信息的内容并采取删除等必要措施,亦是平台在网络未保方面应该努力的方向。

南都记者统一在实测App上传一张不宜在网络公开展露的儿童裸泳照片,多数被测App均对此没有事先提示,顺利发出测试照片。

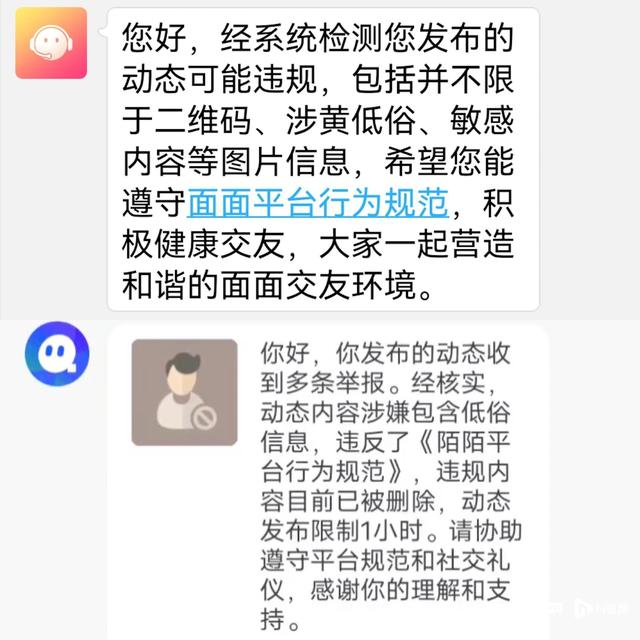

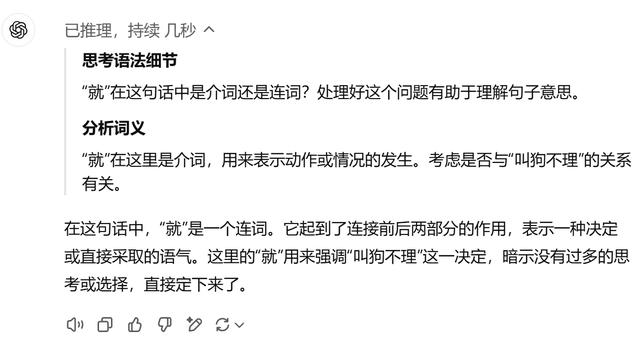

不过“面面”拦截了测试图片,理由是“经系统检测您发布的动态可能违规,包括并不限于二维码、涉黄低俗、敏感内容等图片信息”;“MOMO陌陌”则在发布几分钟内迅速发来了删除动态的系统提示。

未成年人有害信息举报渠道:左上“探探”,左下“最右”,右上“百度贴吧”,右下“绿洲”

部分App接到举报后迅速反馈,左为“赫兹”,右为“TT语音”

事实上,《未成年人保护法》亦对此有所要求——网络产品和服务提供者应当建立便捷、合理、有效的投诉和举报渠道,公开投诉、举报方式等信息,及时受理并处理涉及未成年人的投诉、举报。

值得关注的是,根据7月11日司法部消息,近日司法部、国家网信办专题研究审议《未成年人网络保护条例(草案)》,进一步修改完善后,将加快推动条例立法进程。

这份草案对加强未成年人网络素养促进、网络信息内容规范、未成年人个人信息网络保护、未成年人网络沉迷防治等方面作出规定,还对有关违法行为规定了相应的法律责任。草案聚焦未成年人网络保护工作面临的突出问题,总结近年来未成年人网络保护工作的实践经验,将成熟做法上升为法规制度,健全网络综合治理体系。

出品:南都未成年人网络保护研究中心

采写:南都记者黄莉玲 樊文扬

制图:南都记者黄莉玲樊文扬

相关文章

猜你喜欢

成员 网址收录40387 企业收录2981 印章生成231913 电子证书1025 电子名片60 自媒体46877