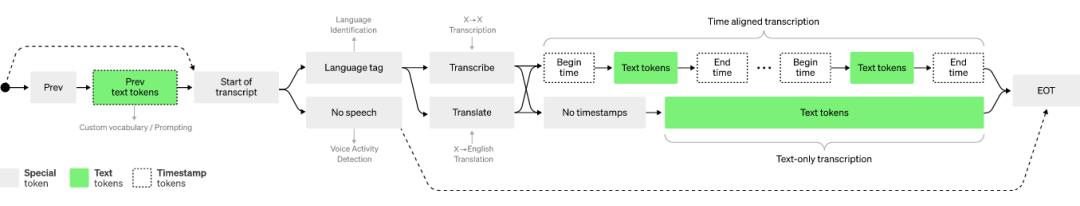

图注:方法概述

在许多不同的语音处理任务中训练一个序列到序列的转换器模型,包括多语言语音识别、语音翻译、口头语言识别和语音活动检测;所有任务都表示为要由解码器预测的标记序列,允许单一模型取代传统语音处理管道的不同阶段;多任务训练格式使用一组特殊的标记,作为任务指定者或分类目标

Whisper 架构采用一种简单的端到端方法,通过编码器-解码器 Transformer 来实现:输入音频被分成30秒的块,转换成 log-Mel 频谱图后传递到编码器。解码器可预测相应的文本标题,并与特殊标记混合,由这些标记指导单个模型执行诸如语言识别、短语级时间戳、多语言语音转录和英语语音翻译等任务。

图注:Whisper 架构

值得一提的是,由于「Whisper 」是在一个庞大且多样的数据集上进行,没有针对任何特定的数据集进行微调,因此它不会击败专门研究 LibriSpeech 性能的模型。

此外研究团队还发现,当在许多不同的数据集上测量「Whisper 」的零样本性能时,「Whisper 」相比其他模型表现更加稳健,错误率降低了 50%。

除了足够大的数据集规模外,「Whisper 」还支持多种语言的转录,以及将这些语言翻译成英语。

当前在68万小时音频中,共11.7万个小时覆盖了96中其他语言,还包括12.5万个小时的转录和翻译数据,即大约有三分之一是非英语的。

「Whisper 」会交替执行以原始语言转录或翻译成英语的任务,对此研究团队发现,这种方法在学习语音到文本的翻译方面特别有效,并且优于 CoVoST2 到英语翻译零样本的监督 SOTA。

目前,「Whisper 」已开源,可用于对语音识别方面的进一步研究。

OpenAI 创始人 Ilya Sutskever 对此表示,“终于有一个能理解我说话的可靠的语音识别系统。”

前特斯拉人工智能和自动驾驶部门负责人 Andrej Karpathy 也转发了这一消息称“OpenAI 正处于最好的状态中”。

那么大家怎么看?

相关文章

猜你喜欢

成员 网址收录40404 企业收录2983 印章生成239783 电子证书1065 电子名片60 自媒体61027