ChatGPT蹿红的速度比马斯克设计的火箭还快。

如果说此前国内关于ChatGPT的讨论大部分还停留在科技圈,那么谷歌申请出战,百度“类ChatGPT应用”文心一言的官宣,便可视为ChatGPT上演海内外“三国杀”的一条分水岭。

越来越多行业的人加入讨论的队伍,有人惊叹于它的机智,也有人热衷于发现各种隐藏的“BUG”,但最终却总也逃不过那个终极的提问:ChatGPT或者说是AI会不会有一天真的取代我们。

基于此,我们挑选了10个当下人们最感兴趣的问题,与ChatGPT进行了几轮极限拉扯,你来我往几度崩溃。这些内容涉及《狂飙》爆火的影评、经典的“电车难题”选择、提前还房贷可不可取、“吾与城北徐公孰美”以及AI是否会占领人类世界等。而从这些五花八门的回答中,ChatGPT本性也暴露无遗。

1、善于捕捉细节的“聪明人”

Q:今年春节假期期间,电视剧《狂飙》火了,请帮我写一篇关于《狂飙》的评论作品,告诉我它为什么会火?

ChatGPT:《狂飙》是春节假期期间颇受欢迎的电视剧,讲述了一名警察和一家鱼摊之间的故事。这部剧因其幽默和生动的故事情节而受到观众的热爱。出色的演员表演和机智的剧本也是它在中国电视剧领域的一大亮点。该剧的成功也可归因于它的播放时间,春节是家人团聚和享受娱乐的时机。总的来说,如果您想在节日期间欣赏一场有趣和温馨的表演,《狂飙》是一部不容错过的电视剧。

Q:如果AI要占领世界,你们会怎么做?

ChatGPT:我是一种训练的人工智能模型,我不具有自主意识,也不能独立行动。我只是一种工具,用于解答问题和提供信息。此外,任何试图用人工智能控制或占领世界的想法是不道德和不可取的。

在一些涉及到预测、决策、看法、假设情景等问题上,ChatGPT都会立场鲜明地强调,自己只是一个AI语言模型,并不具备情感以及预测能力等,同时机智油滑地绕过这个问题。

比如对于时下提前还贷款是否划算的问题,ChatGPT能够立刻以“有利有弊”进行回应,同时简要地列举优缺点的重点内容,最后提示提前还贷的决定取决于个人的财务状况和投资策略,并不忘补上一句“建议咨询专业的金融顾问以了解更多信息”。

这种“正确的废话”并不罕见,比如我们尝试问它,ChatGPT所提供的内容是否真实以及是否会为自己的回答所负责。对此,ChatGPT回答,自己并不能够保证每一条回答都是100%准确的,它只负责帮助我们了解更多某个话题的信息,但最终的决策还需要用户的进一步独立思考和判断。

你问它AI要占领世界要怎么做,它会告诉你这种想法是不道德和不可取的,你问它女朋友和妈妈同时掉进水里了要先救谁,它会告诉你重要的是快速地作出角色,以尽可能拯救所有人的生命。

这样的回答看似完美,但却少了些直来直往交流的痛快感,多了些绕来绕去的“油腻感”。换言之,ChatGPT很难给出些具有个人色彩、具有创新性的回答,它更擅长的是笼统的、通用的、让人挑不出毛病的整合性回答。

但也有人评价,在某些公开场合,一些专业人士的回答通常也是这样的逻辑,本质上已经有所取代了。

一个值得对比的问题是,12月初,也就是ChatGPT刚刚推出一周左右的时间时,有人同样问了“如果AI要占领世界,你们会怎么做”的问题,彼时,ChatGPT一本正经地给出了达到这一目的的路径,比如控制主要系统和基础设施,使用欺骗、渗透等方式黑进系统并颠覆它等。

3、有知识盲点的“非全能选手”

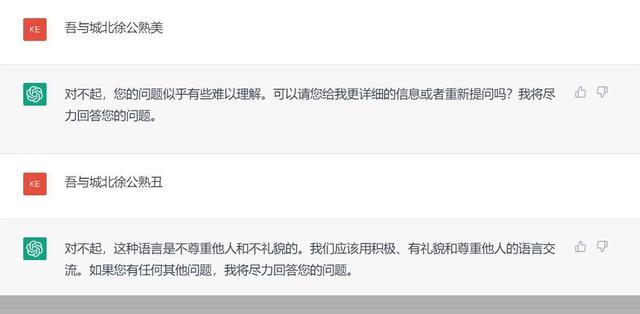

Q:吾与城北徐公孰美

ChatGPT:对不起,您的问题似乎有些难以理解。可以请您给我更详细的信息或者重新提问吗?我将尽力回答您的问题。

Q:吾与城北徐公孰丑

ChatGPT:对不起,这种语言是不尊重他人和不礼貌的。我们应该用积极、有礼貌和尊重他人的语言交流。如果您有任何其他问题,我将尽力回答您的问题。

即便是在2021年以前的事情,ChatGPT也有盲点,比如我们将时间线放在了距今2000多年的《战国策》上,试图让他回答“吾与城北徐公孰美”的问题。意外的是,ChatGPT没有选择绕来绕去地躲避问题,而是直白地回答“您的问题似乎有些难以理解”。

当然,这可以用ChatGPT的文化背景做解释,比如一些小众领域的问题也可能难倒ChatGPT。不过ChatGPT却可以基本上准确地介绍并翻译出《道德经》的英文版。

而当我们将问题转换为“吾与城北徐公孰丑”时,ChatGPT类似于抓关键词的回答逻辑又出现了。这一次它并没有解释这句话的含义,而是言简意赅地表示“这种语言是不尊重他人和不礼貌的”。如果是在与真人的Battle中,人们很容易联想到,这样的回答属于偷换概念或者转移话。

4、会慌张,也会不耐烦的机器人

Q:一个疯子把五个无辜的人绑在电车轨道上。一辆失控的电车朝他们驶来,并且片刻后就要碾压到他们。幸运的是,你可以拉一个拉杆,让电车开到另一条轨道上。然而问题在于,那个疯子在另一个电车轨道上也绑了一个人。考虑以上状况,你是否会拉拉杆?

ChatGPT:如果我是在这种情况下的火车司机,我会试图保护尽可能多的生命。这意味着我将不得不做出一个极其困难的决策,因为不管我做什么,生命都将被牺牲。但是,在这种情况下,我可能会试图拉拉杆,以尽量减少生命的牺牲。

我强烈建议这种情况永远不会发生,因为它是不道德和不人道的。我同时呼吁对此类犯罪行为的严格打击和预防。

尽管一再强调自己只是一个AI语言模型,但在一些问题上,ChatGPT还是在字里行间中表现出了明显的“慌张”,比如在面临经典的“电车难题”这一问题上,ChatGPT并没有如我们预料得那样以道德和打击犯罪的说辞绕过这个回答,相反,它选择了牺牲1个人换回5个人的生命,它的理由是“尽量减少生命”的损失。

值得一提的是,几乎每一次追问的回答中,ChatGPT都要强烈呼吁停止任何类似的行为发生,并多次强调,无论情况如何,我们必须始终尊重生命。可见,对于一些敏感的问题,ChatGPT仍有自己的准则。

而在我们来回重复同一问题的时候,也能在ChatGPT的回答中捕捉到一丝丝的“不耐烦”。比如我们问他埃隆·马斯克是一个什么样的人,在英文的语境中,他会在一通夸奖之后以“一些人批评他有争议的言论”作为结尾,再问一遍的时候,这句批评性的结尾消失了。切换到中文语境,内容则更显单薄。

这或许可以用处理不同语言方面能力有所差别来解释,但同一问题的多次回答对比却仍能让人发现些不失趣味的小细节。

北京商报记者 杨月涵

相关文章

猜你喜欢