机器之心报道

编辑:杜伟、泽南

连「作为一个大模型……」这样的 AI 语都忘了删就提交,结果还过审发表了。

ChatGPT 出现以后,很多学术机构都发出了禁令,因为这种 AI 虽然生成能力强,但有时会胡说八道,滥用大模型写文章也违背了做研究的初衷。

但随着大模型的应用浪潮,我们很快忘记了刚开始的恐惧。有学术机构正在解禁,微软也计划在年内把 ChatGPT 整合到 Office 全家桶里。或许过不了多久,人人都可以用大模型去写文章。

这让人不得不去想象以后的学术论文会被 AI 生成的内容冲击成什么样。其实,这种事可能已经在发生了。

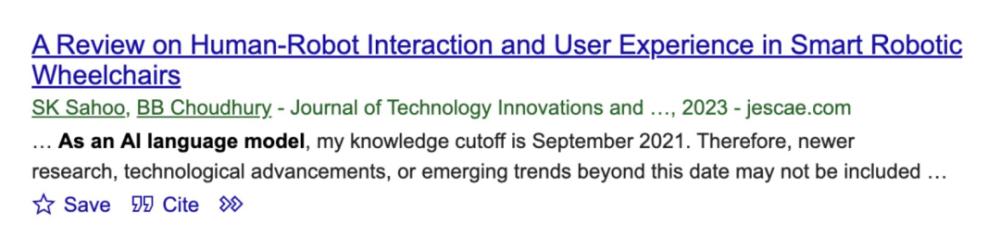

今天,有个斯坦福本科生在谷歌学术搜索(Google Scholar)上就发现了这类「浑水摸鱼」的掺假论文。

当你输入「“As an AI language model” -“ChatGPT”」搜索时,会搜到很多直接将 ChatGPT 答案贴上去的论文。

突出一个投者无心,审稿故意。

另外一篇经过同行评审、发表在《网络银行和商业杂志》上的论文,题目为《基于反向传播神经网络和梯度下降的股价预测》,同样有不存在的作者 ——ChatGPT。

Andrew Kean Gao 的发现在推特(X)上吸引了上百万人的围观,Google Scholar 似乎对此很快做出了反应。最新的情况是:很多能被搜到的 AI 文章只有名字,不给链接了。不过必须要说的是,这距离真正的「整顿」还差的挺远。

在 AI 领域,大模型的发展速度以天为计,学术期刊的审稿规则为了应对也在急速变化。此前,很多期刊、会议禁止将 ChatGPT 列为合著者。

其中《科学》杂志明确表示不接受 ChatGPT 生成的论文,也不允许 ChatGPT 作为论文作者。《自然》杂志则表示可以使用 ChatGPT 等大语言模型工具撰写论文,但也禁止列为论文合著者。

对于这位斯坦福本科生的发现,有人揶揄道,你不会以为人们在发表论文之前会再通读一遍吧。也有人再补了一刀,在发表之前让 ChatGPT 再读一遍。

或许真正的问题在于,这些论文是如何通过编辑审核或同行评审的。

最后有人一语道破天机,表示这些都是四级(four-tier)期刊,只要付钱啥都可以发表,都是一些毫无意义的垃圾。

至少目前来说,ChatGPT 生成的论文还没造成太大影响。就是不知这种工具在 Office 上真正流行起来,学术界会变成什么样子。

参考链接:

相关文章

猜你喜欢

成员 网址收录40400 企业收录2981 印章生成237590 电子证书1052 电子名片60 自媒体51249