内容审核一直被视为互联网大厂中的脏活和累活。就拿审文章来说,审核员们一天要审约2000篇文章,7×24h工作制,经常过着昼夜颠倒的日子,更要命的是,他们每天都要接收各种低俗污秽内容,久而久之,心理也承受着相当大的压力。没有点体力和强大的心脏,这行还真干不了。

别看内容审核员承担着繁重的“内容清洁”的工作,但由于简单重复等工作特性,他们往往是大厂的“边缘人”,而且薪酬也较其他岗位低很多。AI火了之后,不少人认为,要想解救被困在大厂精算系统里的审核员,还得看人工智能。没想到,这一天这么快就到来了。

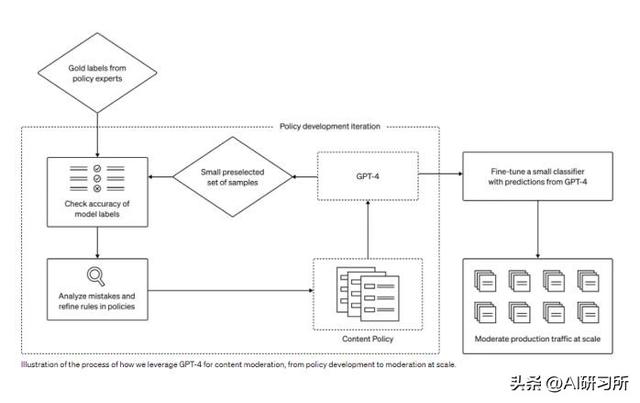

8月15日,OpenAI在官网称,其开发了一种使用GPT-4进行内容审核的解决方案,从而实现更一致的标记、更快的策略优化反馈循环,以及减少人工审核人员的参与。

通过这样的迭代过程,内容审核系统可以很快地适应新的内容审核策略,进而与内容审核要求相一致。

GPT-4的标记质量类似于经过轻度训练的人工版主(B 组)。不过,两者都被经验丰富、训练有素的人类主持人(A 组)超越了

跟Constitutional AI(依赖于模型自己判断是否安全)相比,OpenAI的这个方法可以让基于平台的特定内容政策迭代更快、更省力。

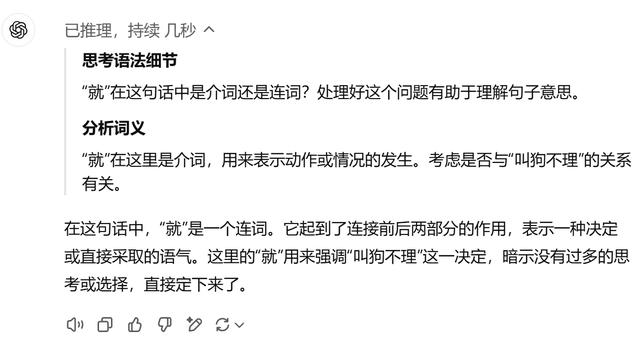

OpenAI表示鼓励安全从业者都尝试这个过程进行审核,只要有OpenAI的API访问权限就行。OpenAI还在尝试通过结合思维链推理或者自我批评,来提高GPT-4的预测质量。另外他们也在尝试检测未知风险的方法,以及利用模型来识别潜在的有害内容,并对其进行高级的描述(也是受ConstitutionalAI)的启发。这些发现也会为全新的风险政策提供信息。

当然,GPT-4也会在训练期间出现偏差,这个过程中还需要人类来监控、验证和完善。而节省的人力,可以用来专注于解决政策需要最需要的复杂边缘情况。

相关文章

猜你喜欢

成员 网址收录40394 企业收录2981 印章生成234174 电子证书1033 电子名片60 自媒体46877