编辑:编辑部

【新智元导读】GPT-4太吃算力,微软被爆内部制定了Plan B,训练更小、成本更低的模型,进而摆脱OpenAI。GPT-4太吃算力,连微软也顶不住了!

今年,无数场微软AI大会上,CEO纳德拉台前激动地官宣,将GPT-4、DALL·E 3整合到微软「全家桶」。

微软全系产品已被OpenAI的模型重塑,愿景是让AI成为每个人的生活伴侣。

然而在幕后,因GPT-4运行成本太高,微软却悄悄地搞起了plan B。

The Information独家爆料称,为了摆脱对OpenAI的依赖,由Peter Lee领导的1500人研究团队中,一部分人转向研发全新对话式AI。

他们清楚地知道,自身没有OpenAI的计算资源,也没有大量的人类审查员来反馈LLM回答的问题,以便工程师改进模型。

过去一年里,随着几波研究人员的离职,包括一些转入微软内部的产品团队,研究部门的人才也在不断流失。

对微软自身来说,在没有OpenAI帮助的情况下,开发高质量的LLM,可以在未来几年,两家公司讨论续签合作关系时赢得更多谈判筹码。

微软AI研究主管Peter Lee

目前,两者交易对双方都有利。

微软投资OpenAI一百多亿美元,作为回报,能够在微软产品中永久使用OpenAI 现有知识产权的独家权利。

此外,微软还将获得OpenAI 75%的理论运营收益,直到其初始投资偿还为止,并且将获得利润的49%,直到达到一定上限为止。

论文地址:https://arxiv.org/abs/2306.02707

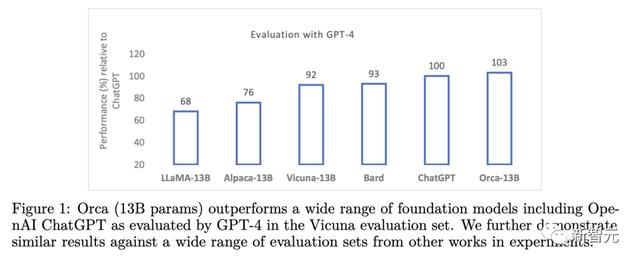

结果显示,Orca不仅超过了其他的SOTA指令微调模型,而且在BigBench Hard(BBH)等复杂的零样本推理基准中,实现了比Vicuna-13B翻倍的性能表现。

此外,Orca在BBH基准上还实现了与ChatGPT持平的性能,在SAT、LSAT、GRE和GMAT等专业和学术考试中只有4%的性能差距,并且都是在没有思维链的零样本设置下测量的。

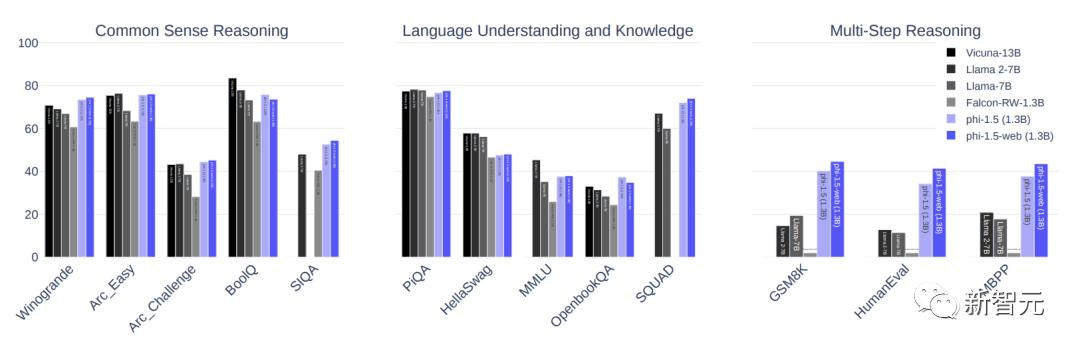

结果显示,phi-1.5在常识推理和语言技能上的表现,与规模10倍于它的模型旗鼓相当。

同时,在多步推理上,还远远超过了其他大模型。

虽然目前还不清楚,像Orca和Phi这样的「小模型」是否真的能与更大的SOTA模型(如GPT-4)相媲美。但它们巨大的成本优势,加强了微软继续推动相关研究的动力。

据一位知情人士透露,团队在发布Phi之后,首要任务就是验证此类模型的质量。

在即将要发表的论文中,研究人员又提出了一种基于对比学习的方法,让工程师们可以教模型区分高质量和低质量的响应,从而改进Orca。

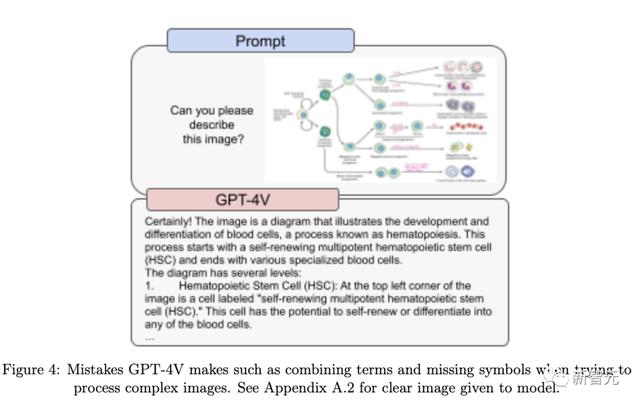

同时,微软其他的团队也正在紧锣密鼓地开发全新的多模态大模型,也就是一种既能解释又能生成文本和图像的LLM。

GPT-4V

显然,像Orca和Phi这样的模型,可以帮助微软降低为客户提供AI功能时所需的计算成本。

据一位在职员工透露,微软的产品经理已经在测试如何使用Orca和Phi而不是OpenAI的模型,来处理必应聊天机器人的查询了。比如,总结小段文本、回答是或者否,这种相对简单的问题。

此外,微软还在权衡是否向Azure云客户提供Orca模型。

据知情人士透露,Orca论文一经发表,就有客户来询问何时能用上了。

但问题在于,如果真要这样操作的话,微软是不是还需要找Meta拿个许可。毕竟后者对哪些公司可以将其开源LLM进行商业化,还是有所限制的。

参考资料:

相关文章

猜你喜欢

成员 网址收录40394 企业收录2981 印章生成234551 电子证书1034 电子名片60 自媒体46877