编辑:编辑部

【新智元导读】ChatGPT日烧70万美元,OpenAI即将陷入破产边缘?诞生9个月,ChatGPT已经花费近2亿美元!

外媒Analytics称,OpenAI很可能到2024年破产。

OpenAI每天大约烧掉70万美元,仅用于维持ChatGPT的运作。这个费用还不包括GPT-4、DALL-E 2等其他AI产品。

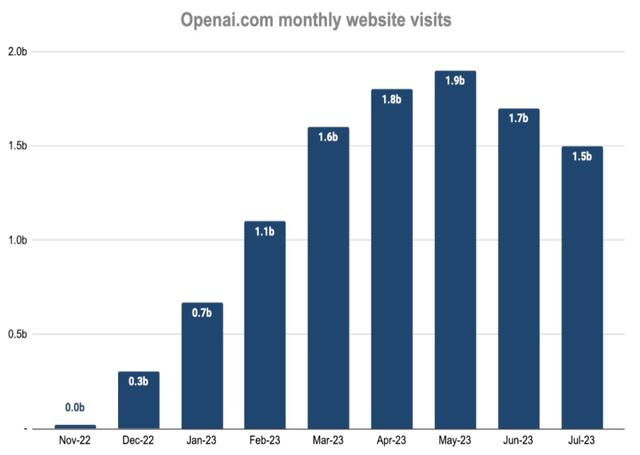

根据Similarweb的统计显示,6月份ChatGPT网站的全球流量下降了9.7%,访问者在网站上花费的时间也下降了8.5%。

另外,7月与6月数据相比,用户基数下降了12%,从17亿用户降至15亿用户。

请注意,这些数据仅显示访问ChatGPT的用户,并未计入使用OpenAI API的用户。

除了面向用户的应用,OpenAI的API也是问题的一部分。

过去,许多最初鼓励员工不要使用ChatGPT的公司,现在正在购买OpenAI的API访问权限,并创建自己的AI聊天机器人,用于各种不同的工作流程。

然而,OpenAI模型再强大,也抵不过「开源模型」的明显优势。

然而,这与首席执行官Sam Altman的想法恰恰相反。Altman个人并不会优先考虑利润,但OpenAI作为一家公司却有需要这么做。

就拿2019年诞生的GPT-3来说,其训练费用高达1200万美元。

前端时间,一篇文章还透露了,GPT-4大约在10000-25000张A100上进行了训练,而要等到GPT-5的面世,还需要5万张H100。

以上种种,都需要OpenAI投入巨额的资金,才能让GPT模型变得更加强大和聪明。

然而,Sam Altman却多次公开声明,如果政府不对AI进行监管,将带来灾难性的后果。

如果OpenAI选择进行首次公开募股(IPO),可能会被一家大型科技公司或企业集团收购。

这将为其现有投资者提供一个很好的退出策略。

然而,一些问题可能会在IPO中造成阻碍,这反过来可能不会带来太大的价值。

GPU短缺更进一步复杂化的问题是,企业级GPU的持续短缺。

生成式AI爆发仍旧没有放缓,对算力提出了更高的要求。一些初创公司都在使用英伟达昂贵、且性能极高的H100来训练模型。

马斯克还谈到,在这一点上,GPU比药物更难获得。

Sam Altman表示,OpenAI受到GPU的限制,推迟了我们的短期计划(微调、专用容量、32k上下文窗口、多模态)。

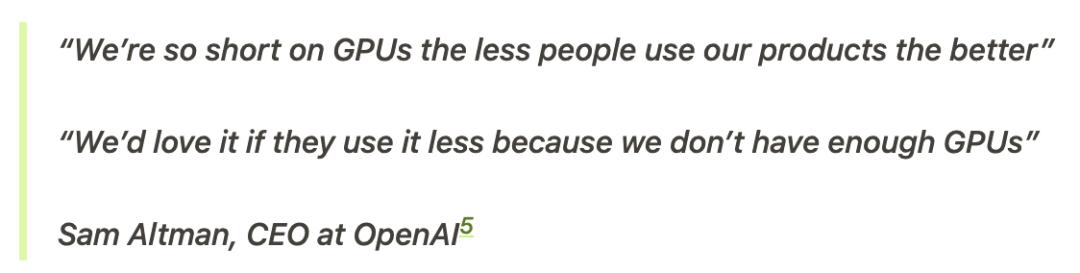

甚至,因为GPU的短缺,Altman都不希望有很多人使用ChatGPT。

我们的GPU非常短缺,使用我们产品的人越少越好。

如果人们用的越少,我们会很开心,因为我们没有足够的GPU。

虽然Altman口口声声地说,我们没有训练GPT-5,但近来GPT-5商标申请,已经向外界透露了,OpenAI继续训练模型的意图。

OpenAI可能需要50000个H100来训练GPT-5。报道称,英伟达最好的芯片H100,将在2024年之前就会售罄。

如果市场上GPU跟不上,将会阻碍OpenAI提升和训练新模型的能力。

持续的亏损,用户基数的缩减,无法实现大额营收,甚至GPT-4输出质量降低等综合因素,愈加凸显了OpenAI面临着严重困境。

对于OpenAI自身来说,急需找到实现盈利的方法。

微软:我会负责赚钱的

不过,虽然OpenAI不怎么赚钱,但金主爸爸微软早就在想尽一切办法要把他们搞出来的成果变现了。

2021年11月,微软首次推出Azure OpenAI服务,让用户可以非常便利地使用大规模生成式AI模型。

比如,利用Azure OpenAI上搭载的DALL-E 2,用户只需在提示栏中不断明确自己的要求,模型就会生成越来越符合用户要求的图像。

参考资料:

https://analyticsindiamag.com/openai-might-go-bankrupt-by-the-end-of-2024/

相关文章

猜你喜欢