梦晨 发自 凹非寺量子位 | 公众号 QbitAI

专攻代码的Code Llama一出,大家伙都盼着谁来后续量化瘦身一下,好在本地也能运行。

果然是llama.cpp作者Georgi Gerganov出手了,但他这回不按套路出牌:

不量化,就用FP16精度也让34B的Code LLama跑在苹果电脑上,推理速度超过每秒20个token。

Andjrey Karpathy把这个方法比喻成“先让小模型打草稿”。

他解释这个方法有效的关键之处在于,给大模型一次输入一个token和一次输入一批token,预测下一个token所需时间是差不多的。

但每一个token都依赖前一个token,所以正常情况无法一次对多个token进行采样。

小模型虽然能力较差,但实际生成一个句子时有很多部分是非常简单的,小模型也能胜任,只有遇到困难的部分再让大模型上就好了。

原论文认为,这样做无需改变大模型的结构,也无需重新训练,就可以直接加速已有的现成模型。

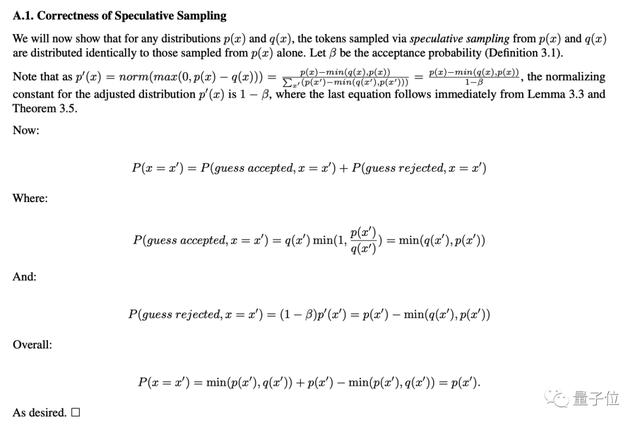

对于不会降低精度这一点,在论文附录部分也给出了数学论证。

了解了原理,再来看Georgi Gerganov这次的具体设置。

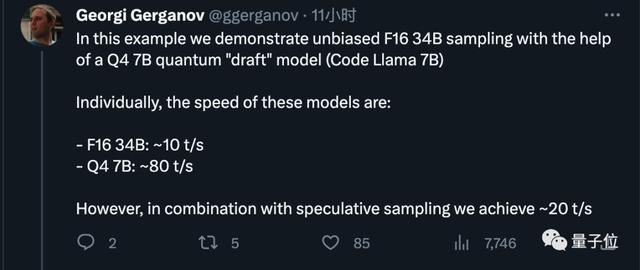

他使用4bit量化的7B模型作为“草稿”模型,每秒约能生成80个token。

而FP16精度的34B模型单独使用每秒只能生成10个token。

使用投机采样方法后获得了2倍的加速,与原论文数据相符。

最后,他还建议Meta以后在发布模型时直接把小的草稿模型附带上吧,受到大伙好评。

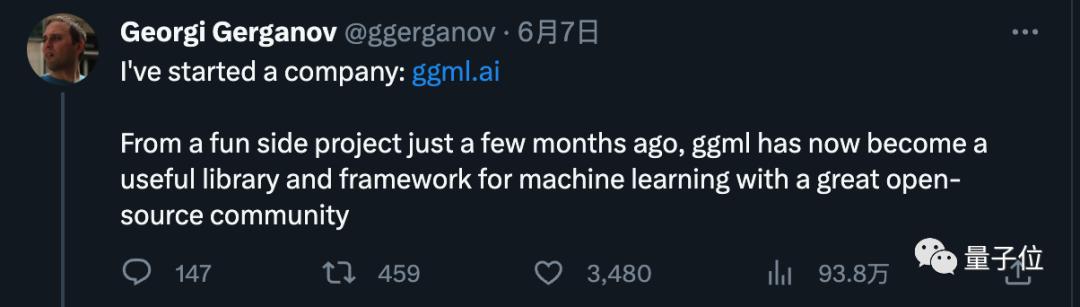

最开始他搞这个只是当成一个业余兴趣,但因为反响热烈,6月份他直接宣布创业。

新公司ggml.ai,主打llama.cpp背后的C语言机器学习框架,致力于在边缘设备上运行AI。

创业时获得来自GitHub前CEONat Friedman、Y Combinator合伙人Daniel Gross的种子前投资。

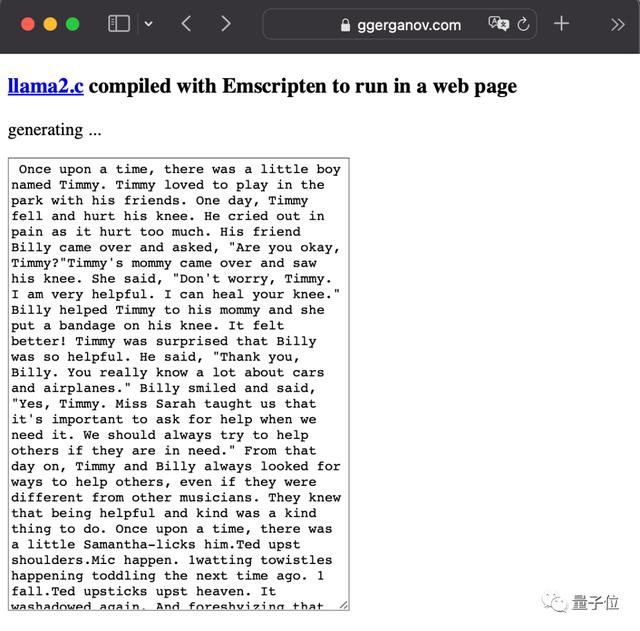

LlaMA2发布后他也很活跃,最狠的一次直接把大模型塞进了浏览器里。

谷歌投机采样论文:https://arxiv.org/abs/2211.17192

参考链接:[1]https://x.com/ggerganov/status/1697262700165013689[2]https://x.com/karpathy/status/1697318534555336961

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

相关文章

猜你喜欢