本文素材来自于网络,若与实际情况不相符或存在侵权行为,请联系删除。

GPT-4的发布掀起了巨大的轰动,Greg Brockman和Ilya Sutskever从不同的角度对其性能进行了评价,同时也解释了安全和开源争议。

GPT-4无疑是一项引人瞩目的成就,凭借其卓越的推理和多模态能力,引发了广泛的研究和探讨。然而,令人遗憾的是,GPT-4并不是一个开源的模型。

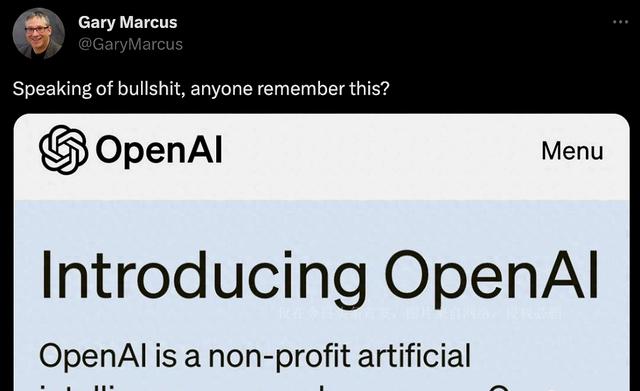

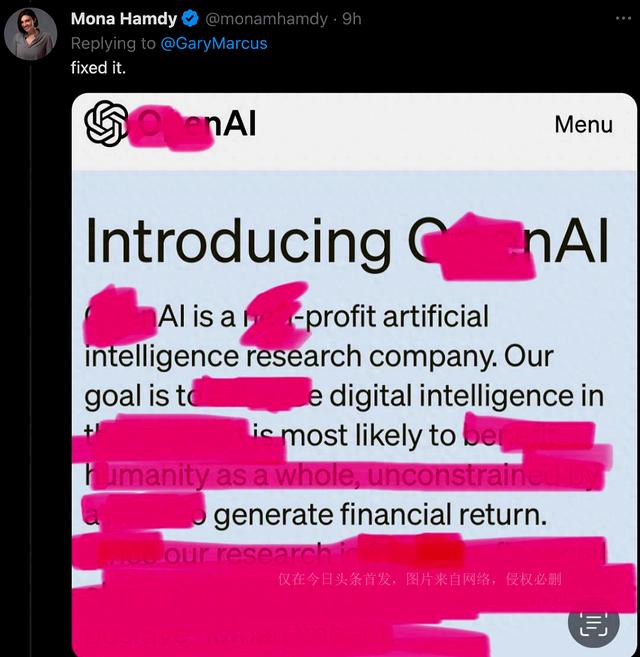

虽然OpenAI公开分享了大量GPT-4的基准和测试结果,但却没有提供用于训练的数据、成本以及创建模型的方法。这一决策引发了广泛的批评,许多人认为这背离了OpenAI作为研究机构的初衷,也增加了应对潜在威胁的困难。

对于这一争议,OpenAI的首席科学家Ilya Sutskever解释称,不分享更多关于GPT-4的信息是出于竞争和安全的考虑。他指出,随着模型能力的提升,开源可能不再明智,因为这种强大的模型有潜在的滥用风险。

然而,这一决策也引发了对人工智能治理的讨论。一些专家认为,需要独立的第三方机构参与审查与模型相关的风险,以避免人工智能领域的权力过度集中化。

总的来说,GPT-4的发布不仅展示了人工智能领域的巨大进步,也引发了对其治理和透明度的重要讨论。在未来,平衡创新和安全的挑战将继续推动这一领域的发展。

与此同时,GPT-4的强大能力引起了广泛的研究兴趣,吸引了众多学者和专家的关注。然而,作为封闭模型,它的发布也引发了一系列讨论,涉及到伦理、隐私和安全等重要问题。

OpenAI的联合创始人Greg Brockman提到,应用GPT-4需要谨慎推进,因为需要评估风险和利益。特别是在面部识别等政策问题上,需要明确定义红线,以确保技术的应用不会导致潜在的滥用。

安全风险也是一个关键问题。一些研究者已经展示了如何绕过内容过滤器,使用GPT-4生成有害的文本,这引发了对审核机制的改进的迫切需求。OpenAI声称GPT-4经过了六个月的安全培训,但也承认模型在这方面仍有不足。

为了解决这些问题,OpenAI推出了名为"系统信息"的API级能力,用于设定模型的行为和界限。这一工具可以帮助规范模型的输出,降低潜在的风险。

总之,GPT-4的发布代表了人工智能领域的新里程碑,但也带来了众多挑战。平衡创新和安全,保护隐私和伦理,将是未来人工智能研究和应用的核心议题。通过开放合作和审慎的监管,我们有望实现更加可持续和负责任的人工智能发展路径。

以上内容资料均来源于网络,本文作者无意针对,影射任何现实国家,政体,组织,种族,个人。相关数据,理论考证于网络资料,以上内容并不代表本文作者赞同文章中的律法,规则,观点,行为以及对相关资料的真实性负责。本文作者就以上或相关所产生的任何问题概不负责,亦不承担任何直接与间接的法律责任。由于平台规则,只有当您跟我有更多互动的时候,才会被认定为铁粉。如果您喜欢我的文章,可以点个“关注”,成为铁粉后能第一时间收到文章推送。本文仅在今日头条首发,请勿搬运。

相关文章

猜你喜欢