在国外,一个叫Alex的男孩被不知名的疾病折磨3年。期间家人带他求医问诊无数,但都是头疼医头脚疼医脚,始终未能找到真正的病因。

直到有一天,男孩的母亲试着在网上寻求ChatGPT的帮助,她把孩子的相关症状罗列出来,后者给出了一个此前她从未见过的答案——脊髓栓系综合征。

过后,母亲带着孩子和ChatGPT给出的答案再次找到了医生。这次的医生在看过结果并再次给男孩进行检查后,也确认男孩患有该病。

而此时,男孩先后看过的医生已经有18位了,都没有诊断出这种稀有的疾病。

这件事一出来,便引起了网民的热烈讨论。

有其他人有分享了自己的亲身经历,或是给人看病,或者是给宠物狗问诊,ChatGPT都能给出令人满意的答案。

就连马里兰大学医学院的研究人员,也曾以研究的形式问诊ChatGPT。研究人员问了它二十多个关于乳腺癌以及筛查等相关问题,它的回答经过专业人员的评估后,发现其中88%的内容都是恰当的。

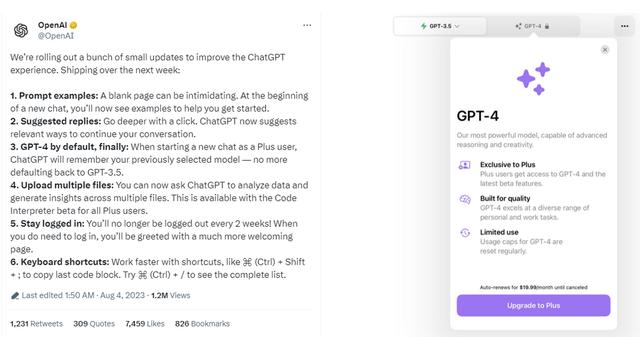

甚至于ChatGPT的升级版GPT-4,据说此前在试验中,还通过了美国职业医师考试。

从这些情况来看,似乎ChatGPT坐堂问诊已指日可待。不过也有些人对它的表现持有怀疑态度甚至不屑一顾:只要吸取的信息和知识够多,完全能做到瞎猫撞上死耗子。

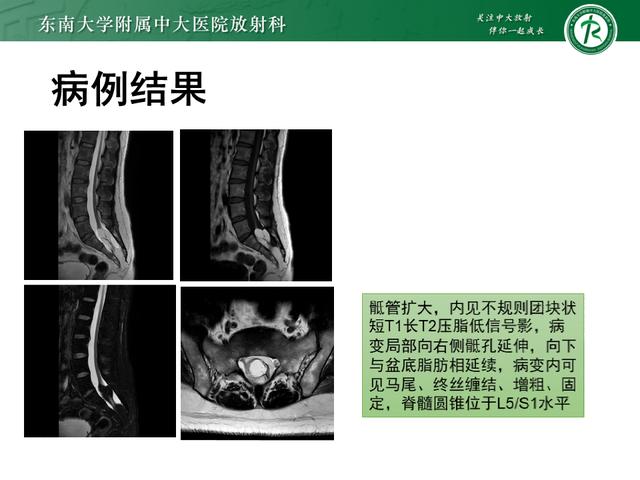

ChatGPT会看病的原理是什么?以Alex的情况为例,他患有的脊髓栓系综合征属于罕见病,成年人少见通常以儿童为主,患病率在0.005%到0.025%之间。

由于发病率低,从医生的角度看,通常不会把一个患儿跟这种病联系在一起。最为关键的是,现代医学体系是以专科专攻为主,不同科室的医生都有各自的主攻方向,不存在全科医生的情况。

如此一来,面对那些较为罕见的疾病,医生一时判断不出来就很正常。而人类的短板,恰恰是ChatGPT的长处。因为从理论上说,它可以做到无限量汲取人类现有的任何知识。而它之所以能诊断出病因,正是建立在了解的基础上。

一切取决于现阶段人类的内容“投喂”

一切取决于现阶段人类的内容“投喂”吕海龙是精神卫生科的医生,今年初的时候,他和浙江大学一附院的团队成员做了一个实验。研究人员让ChatGPT参加了一场中国执业医师的考试。

参与实验的ChatGPT,其所掌握的数据信息,是2021年之前训练得出来的,相关考题则是2020年执业医师考试的试题。

综合来看,一张满分100分的试卷,ChatGPT的成绩只有57分,连及格线都没有达到。

从具体的类型来看,很多基础性的医学类知识,ChatGPT都回答错了,吕海龙和团队成员猜测,最大的原因可能是此前它从网上获取的信息就是错误的。

对比之下,一些需要逻辑思考的实践题,它回答的还算不错,但这类问题在实验中,给ChatGPT设置的前提条件也很充足。

一旦某些问题设置的信息有缺失,它要么回答不上来,要么就是给出答非所问的答案。所以这也能看出来,在逻辑思考上,ChatGPT基本上还不会思考,跟不会像人类一样去运用猜测和联想。

但这一切都基于未来的发展,目前ChatGPT还达不到这样的水准。相关产品的记忆、计算、逻辑判断以及推理等可能与人脑持平甚至超过了人类,但是智能的起点,也就是自我认知的能力,目前的AI产品没有,而且也模拟不出来。

所以就现在的情况来看,ChatGPT还做不到独立给人看病,它最多只能作为辅助,成为医生在临床上的一个智能助手。

至于文章开头的案例,那不过是它基于海量的储备知识,正好给出了一个准确的判断。但是个案不能代表全部,尤其在医学领域,个案更不能代表普遍的临床实践。

当然在医学领域之外,也有诸如教育、新闻等行业,试图训练和利用ChatGPT做出某种突破性的改变。不过整体看来,目前都还位于起始点,颠覆性的突破还没有出现。

结语:人类跟得上ChatGPT的变化吗

结语:人类跟得上ChatGPT的变化吗前一段时间,据说一家美国的媒体,曾利用ChatGPT代替人工报道体育方面的消息,然而在用过一段时间后,它写出来的新闻要么错误百出,要么不知所云,文笔和人的文笔比起来更是味同嚼蜡。最后不得已只能将该项目关停。

这就是将ChatGPT投入到实际产业中一次失败的尝试。

诚然,ChatGPT的优势肉眼可见,但是它的短板也相当突出。归根结底,没有判断能力就不存在认知能力,既然没有认知,它所有的知识储备就都是“死”的,无法真正像人类这样将其串联起来。

至于这种关键的改变何时会发生,目前人类自己也不知道。就像宗教传说中那样,亚当和夏娃,最早也是吃了禁果之后,才产生了自由意志和自我意识。

同样,目前ChatGPT这样的AI产品,它们缺少的就是那颗最关键的禁果。现有的人类科技水平,同样不清楚这样的变化将会带来什么。

现在对于ChatGPT的研究,都是建立在它还没有自我认知的基础上的。大量的实验以及相关的训练,都是想把它变成全知全能的人类助手。

可从本质上来看,这里面可能存在一个悖论,假如未来的AI产品真做到了全知全能,你觉得它不会演化出自我认知吗?

如果脑洞开的再大一点,现今ChatGPT这样的初级产品,又何尝不是在人类的调教下,一步步的演化呢?人类又如何能分辨出来,它不是对自我的认知进行了掩藏和修饰呢?

既然要赋予其智能,既然想创造出新的智能,这些情况就不可能不会出现,一切只不过是时间问题罢了。

当然,现在还没有到达那种地步,ChatGPT还是既聪明又蠢萌的聊天工具。未来它在变,人类也跟着改变认知才行。

参考资料:

《ChatGPT能看病吗?医生出了一百道单选题,它没及格》 澎湃新闻 2023年2月22日《是“公平台”还是“狗屁通”?ChatGPT真的“无所不知”吗?》 大象新闻 2023年2月10日《国产医疗版"ChatGPT"来了,能给我们看病吗?》 南方日报 2023年2月10日

相关文章

猜你喜欢