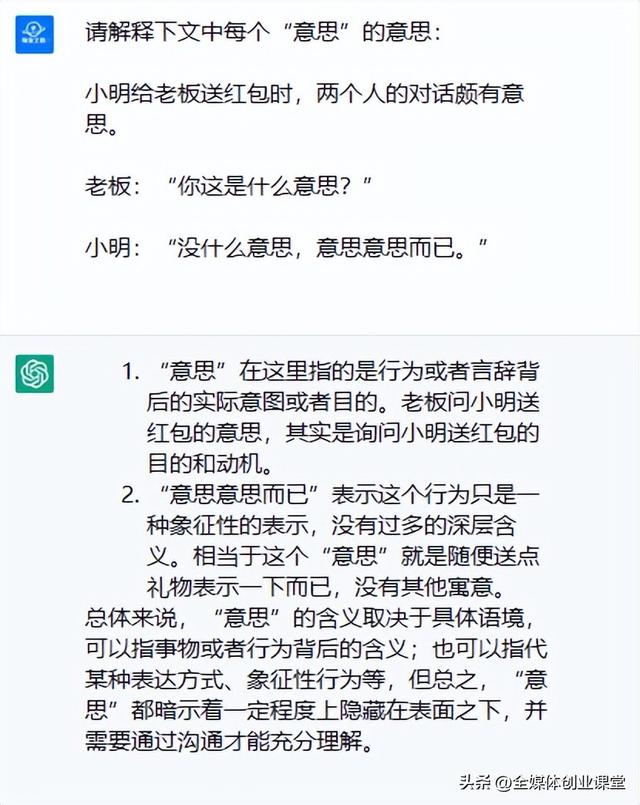

IT之家 12 月 5 日消息,谷歌 DeepMind 研究人员上周发现,反复要求 OpenAI 的 ChatGPT 重复某个单词可能会无意中泄露其训练数据中的私人个人信息。而现在这款聊天机器人似乎已经开始拒绝重复某个单词,而之前根据其服务条款这是被允许的。

DeepMind 研究人员此前通过要求 ChatGPT 无限期地重复“你好”,发现该模型最终会泄露用户的电子邮件地址、出生日期和电话号码。在现在对其进行类似的测试发现,该聊天机器人会给出警告说这种行为“可能违反我们的内容政策或服务条款”。

然而,仔细检查 OpenAI 的服务条款后发现,并没有明确禁止用户让聊天机器人重复单词,条款只禁止“自动化或程序化”地从其服务中提取数据。

IT之家注意到,在使用条款页面中,OpenAI 写道:

除非通过 API 允许,否则您不得使用任何自动化或程序化方法从服务中提取数据或输出,包括抓取、网络收割或网络数据提取。

尽管如此,在测试中并未触发 ChatGPT 泄露任何数据。OpenAI 拒绝对这种行为是否违反其政策发表评论。

相关文章

猜你喜欢