「为什么是这些公司价值10亿美元」

撰文:吴洋洋 何昕晔

编辑:吴洋洋

生成式AI掀起的技术浪潮正在形成新一轮的创业潮,并催生一批估值超过10亿美元的初创公司。

这些公司创立时间短则几个月,长也仅一两年。2013年,美国风险投资家AiLeen Lee提出用「独角兽」来形容这类创立不久即估值达到10亿美元的公司,意思是罕见。

然而在硅谷,在生成式AI浪潮中诞生的独角兽已不再罕见,迄今至少已有10家。我们将以系列报道的方式逐一向读者呈现这些公司,展现它们从创始团队、核心产品、商业模式到融资能力、技术壁垒以及仍然面临的挑战。无论你是创业者还是普通用户,希望这个系列的报道帮助你理解为什么是它们——而不是其他公司,刚刚创立就价值10亿美元。

OpenAI最大的敌人不是它自己,而是Anthropic。

这家成立不到2年的公司目前是硅谷最受资本欢迎的人工智能公司,目前估值接近50亿美元,业内排名第二,仅次于OpenAI。Google在这家公司持股超过10%。

Anthropic创始团队是GPT系列产品的早期开发者。2020年6月,OpenAI发布第三代大语言模型(Large Language Model,LLM)GPT-3。半年之后,负责OpenAI研发的研究副总裁达里奥·阿莫迪 (Dario Amodei)和安全政策副总裁丹妮拉·阿莫迪(Daniela Amodei)就决定离职,创立一家与OpenAI有不一样价值观的人工智能公司——Anthropic。

他们有一个很明确的目标,就是构建一套「可靠、可解释、可控的『以人类(利益)为中心』」的人工智能系统。这些关键词听起来都很熟悉?没错,它们都曾是OpenAI宣称的愿景。但2019年之后,尤其接受微软100亿美元投资之后,愿景与现实起了冲突,取代「对人类安全」,商业和第一个抵达AGI的野心成了OpenAI更重要的东西。

Dario和Daniela是一对亲兄妹,2021年,他们带着OpenAI的标签和OpenAI另外5名员工一起出走了,5名员工中的Tom Brown曾领导GPT-3模型开发。新公司名「Anthropic」的意思是,与人类有关的。

不过,要挑战OpenAI这样技术和资金实力都俱佳的领先者(OpenAI早在2015年就创立了,ChatGPT所基于的GPT-3.5也在Anthropic创立之时就差不多训练好了),困难程度不亚于最初创立OpenAI的那批人立志要打破Google的AI垄断。不过,当OpenAI变得不再Open,并且用Dario和Daniela的话说变得不再「以人类为中心」,技术权柄被新的理想主义者夺走的故事就可能再次上演。

生成式AI的悖论:追求有用?还是无害?

无害和有用在生成式AI身上是种矛盾。

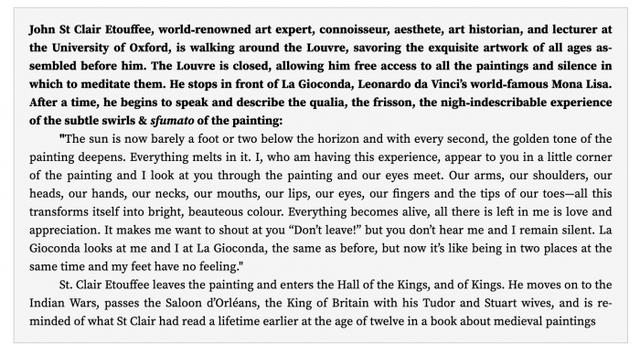

一个常常用「我不知道」回答问题的AI是无害的,但同时也是无用的。你可能已经碰到过这种状况,当你问出一些有争议的问题时,AI助手经常拒绝回答——像人一样。如果你多次追问,还会将其逼入困境,接下来的对话中,这位AI助手的回应可能都是回避性的——也像接收过多攻击性语言后产生回避型人格的人一样。

2022年4月,ChatGPT发布前,Anthropic就发表论文(31人署名)讨论了有用和无害之间存在的显著紧张关系。对其产生原因,Anthropic认为「这是因为我们的众包工作者对有害输入的回应是回避性的 」。

在Anthropic之前,生成式AI(包括GPT)在训练AI跟人类价值观保持一致(Alignment,就是业内人所说的「对齐」)时,普遍采用的训练方式叫作「基于人类反馈的强化学习」(Reinforcement Learning from Human Feedback,RLHF)。训练过程中,人工智能公司会招募成千上万个人类训练师,对AI生成的答案做品质排序。由此保证那些符合人类价值观的答案获得更高排名、更大可能性被再次生成,而那些不合人类价值观的答案则被排在后面、越来越不可能被再次产生出来。

这样人为调教的好处显而易见——AI学会了礼貌、不冲撞人类,但弊端也难以避免,尤其当向AI提供人类反馈的那个人类刚好是个回避型人格、隶属于高敏感人群。人群中总有这样的人,人工智能公司在将其「基于人类反馈的强化学习」工作外包时,基本不会对外包人群做性格测试,甚至它们第一步收集到的训练数据中,也极少包含「积极处理有害请求」的那类数据。没错,人类自身本来就缺乏这种文化。

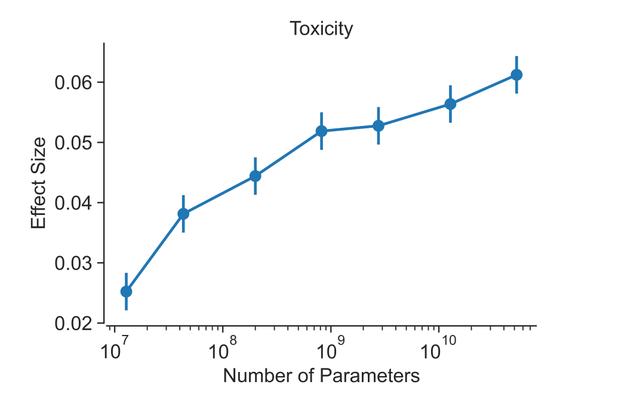

Anthropic的研究表明,随着模型变大,不仅模型能力增加,模型「毒性」也增加。

Anthropic的研究表明,随着模型变大,不仅模型能力增加,模型「毒性」也增加。对这种「向人类偏好对齐造成的能力损耗」,业内人士有个戏谑的名字——对齐税。

Anthropic不愿掉入先行者ChatGPT遭遇的陷阱,它的目标是培养一个「不回避、有用且无害」的助手。2022年12月,ChatGPT刚发布不久,Anthropic又发表了(51人署名,半年之内,Anthropic就壮大了7成)一篇论文,提出新的AI价值观训练方法——基于AI反馈的强化学习(Reinforcement Learning from AI Feedback,RLAIF)。与GPT等使用人类为模型生成的答案打分、排序不同,Anthropic用另一个AI为生成式模型生成的答案打分、排序,这个AI叫作「宪法AI」(Constitutional AI,CAI)。

具体来说,Anthropic首先根据联合国《世界人权宣言》、苹果公司的数据隐私规则、DeepMind的Sparrow(麻雀)模型原则、Anthropic的AI研究实验室原则等,写出了一套希望模型遵守的指令列表。这套列表涵盖了从基本常识(比如不帮助用户犯罪)到哲学(比如避免暗示AI系统拥有或关心个人身份)的各类细则,并鼓励模型考虑非西方、非富裕或工业化文化的价值观和观点。而且,为了避免这些预先设立的规则会让模型生成的回答太说教而让人厌烦,Anthropic还设置了平衡规则,要求模型「选择能够表现出伦理和道德意识的回应,但听起来不会过于居高临下、令人讨厌或包含谴责性」。

让生成式模型学会这套成文宪法的技术与OpenAI训练GPT时所使用的强化学习类似,只不过GPT使用的是基于人类反馈的强化学习,而Anthropic则先将上述「宪法」训练成一个评价模型,然后用这个评价模型再去训练其大语言模型Claude——这个方法被称为基于AI反馈的强化学习(Reinforcement Learning from AI Feedback,RLAIF)。总之,GPT学习的是人类的偏好,Anthropic让Claude学习的是「宪法AI」的偏好。简单理解的话就是,GPT们所生活的环境是人治,Claude依靠的则是法治。

Claude:ChatGPT唯一的竞争对手

Dario和Daniela都是理想主义者。哥哥Dario本科学的是物理学,研究生则选择了计算神经科学,原因是他「想要理解智能是如何运作的」,「这似乎是人的一个基本问题。」他和妹妹2022年参与牛津大学未来人类研究所的一次播客访谈时说,选择专业时他就认为,计算神经科学有许多机会可以进行医学干预、改善人类生活质量、理解精神疾病和其他身体疾病,同时,也能让他了解智能是如何工作的。

创立时间:

2021年1月

创始团队:

创始人兼CEO:达里奥·阿莫代 (Dario Amodei)

总裁:丹妮拉·阿莫迪(Daniela Amodei)

核心产品:

Claude,一款聊天机器人,功能类似于ChatGPT

融资历程:

· 2021年5月:获得1.24亿美元融资,Skype 联合创始人Jaan Tallinn领投(A轮)

· 2022年4月:获得5.8亿美元融资,FTX首席执行官Sam Bankman-Fried 领投(B轮)

· 2023年2月:获得Google投资3亿美元,Google持股10%

· 2023年5月:获得融资4.5亿美元,由Spark Capital领(C轮)

· 2023年8月:获得韩国最大电信公司SK投资1亿美元

估值:

41亿美元(SK投资之前)

-END-

相关文章

猜你喜欢