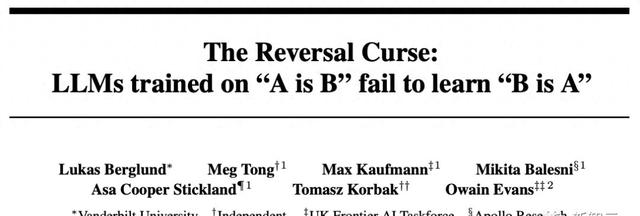

最新研究揭示了大型语言模型的一个令人惊讶的局限性,被戏称为「逆转诅咒」。这项研究表明,尽管这些模型可以学会「A是B」的关系,但它们无法推断出「B是A」的关系。这一发现引发了广泛的关注和讨论,许多AI领域的专家对此表示惊讶。

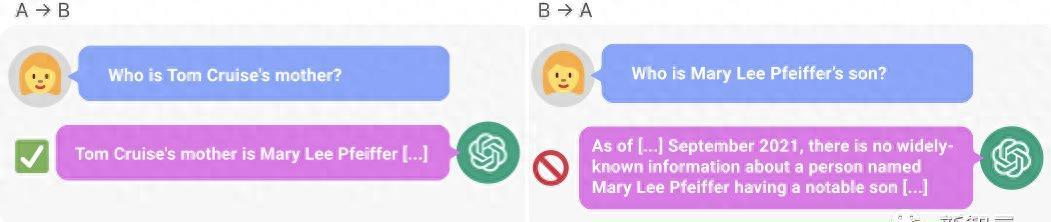

研究人员通过一系列实验来验证这一现象。首先,他们利用虚构的数据对大型语言模型进行微调,教模型关于「A是B」的关系。然后,他们测试模型是否能够泛化到「B是A」的情况。结果显示,模型在这种情况下的表现几乎是零。

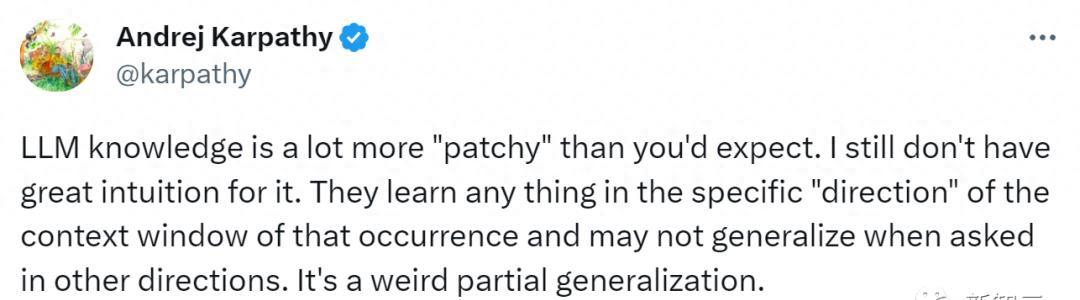

OpenAI的科学家Karpathy对这一发现表示了惊讶,他指出大型语言模型的知识是相当零散的。这一现象引发了对模型内部工作方式的深入思考,以及对AI领域未来发展的探讨。

研究人员还进行了一系列实验,探讨了「逆转诅咒」对模型在实际应用中的影响。结果显示,模型在某些情况下能够正确推断「A是B」的关系,但在「B是A」的情况下表现不佳。这可能是因为互联网上的文本数据更倾向于包含前者而不是后者。

有趣的是,人类思维中似乎也存在类似的「逆转诅咒」。当我们试图以相反的顺序检索信息时,往往比正向操作更困难。这一现象在实验中得到了验证。

总的来说,这项研究揭示了大型语言模型在推理能力方面的局限性,引发了对AI发展方向的深刻思考。对于AI领域的研究和发展来说,这是一项重要的发现,可能会引领未来的研究方向。

相关文章

猜你喜欢