作者:lewisywliu,腾讯PCG客户端开发工程师

ChatGPT是什么首先从全称看,Chat Generative Pre-trained Transformer,分为两部分。前部分为chat,聊天,ChatGPT是从聊天切入人们的生活,从聊天开始,但是又不止于聊天。后半部分是使用到的相关模型与架构。

G是生成式,P是预训练模型,T是Transformer架构。

时间上应该更早点(2003年是论文发表时间)。即神经网络语言模型,这里将神经网络和自然语言模型相结合,可以说是一个开创性的思想,之后很多年的时间,自然语言模型都是围绕着神经网络来开展的。

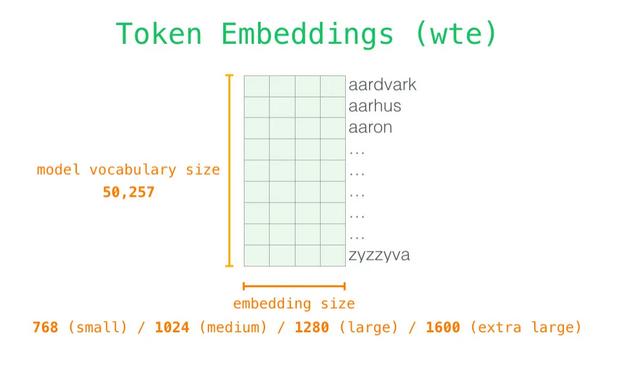

除了神经网络,论文中还引入了词嵌入的概念,将离散的单词字符转换成连续空间的向量。不过NNLM的输入是固定长度的词嵌入,所以导致了无法处理长距离的预览关系(即无法处理长上下文信息)。

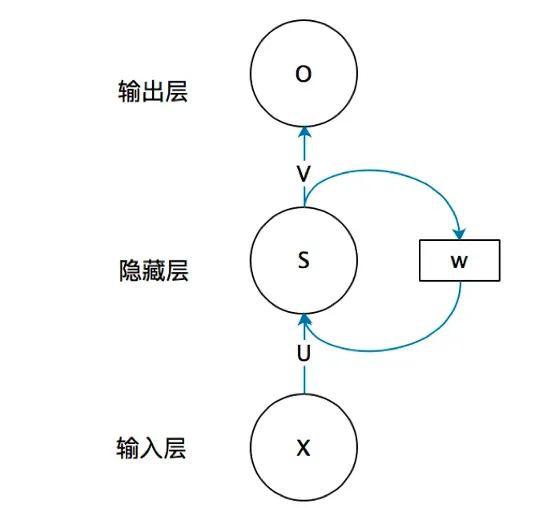

2010年谷歌提出RNNLM

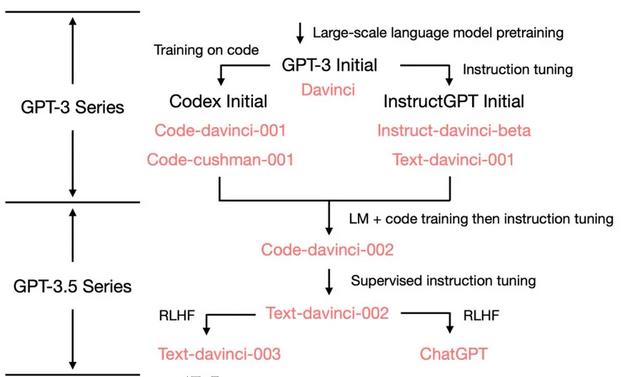

从这个版本开始,GPT不在开源,openAI从此变成了closeAI。在GPT-2的基础上,openAI开始海量的堆数据,我们可以看看这个图,到GPT-3的时候,参数量和预训练数据量有了超百倍的提升。豪赌1200万美金,也可以说是大力出奇迹,效果确实很好。

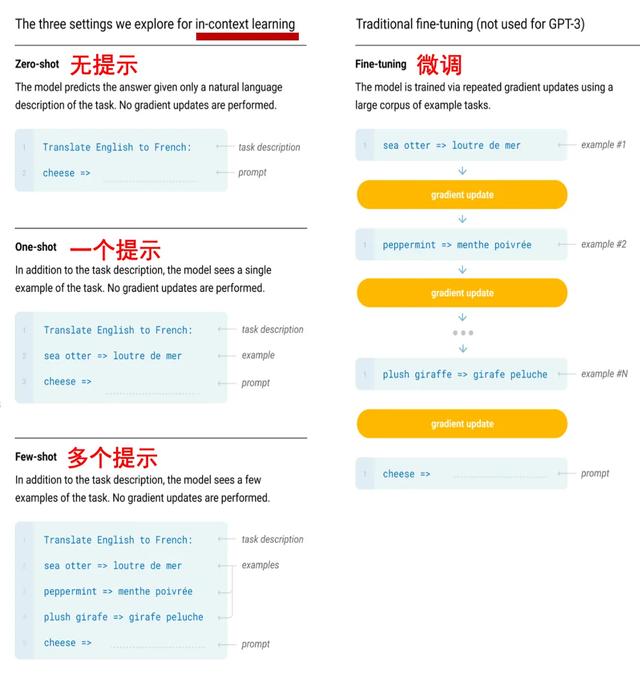

这是最终得到的准确性效果,可以看出在模型参数增大的情况下,准确性都会提高,并且给较多的提示,准确性会提升的的更多。这里的相当于在和GPT-3聊天的过程中,GPT-3能够理解上下文,根据上下文更好的完成当前的任务。

到这里GPT-3已经学习了很多很多内容,但是内容中有好有坏的,或者说会被内容带偏,例如种族歧视、性别歧视。所以这里直接商用的话,还是存在了一些问题。

今生GPT3 RLHF ≈ GPT3.5 ≈ ChatGPTopenAI对GPT-3进行微调,衍生出GPT-3.5,3.5之所以叫3.5,是因为是基于GPT3,做了特定领域的微调后,衍生出新的模型。

这个图是InstructGPT论文中给出的炼丹过程,也就是RLHF(基于人类反馈的强化学习),大概得意思是,基于GPT3,第一步提一些问题,并人工对回答进行标注,标注对与不对,然后训练出SFT模型。第二步基于SFT,提问,然后回复多个答案,人工对多个答案进行打分,得出4个答案的得分排序,得出RM模型,就是奖励模型。第三步就是利用PPO算法继续调整模型的参数,让他生成的答案可以达到RM模型中更好的答案。最后循环这个流程,得出的就是instructGPT。

这里我们可以知道,GPT-3进行微调、强化学习后,得到了instructGPT。而ChatGPT也是用的这样的方法训练出来的。

GPT4到现在的GPT-4,openAI这次发布的GPT-4技术报告,没有讲到太多的技术细节,也没有说模型具体是怎么训练的,重点表达了

GPT-4是个输入多模态的模型,训练的方式和GPT3.5类似,也是大模型 RLHF(其实在大模型堆料出来后,已经有了一定的效果了,而RLHF不是一定可以提高模型的准确性,但这里可以让结果更符合我们想要的,例如更安全、更像人类语言)。效果有多么多么的强。

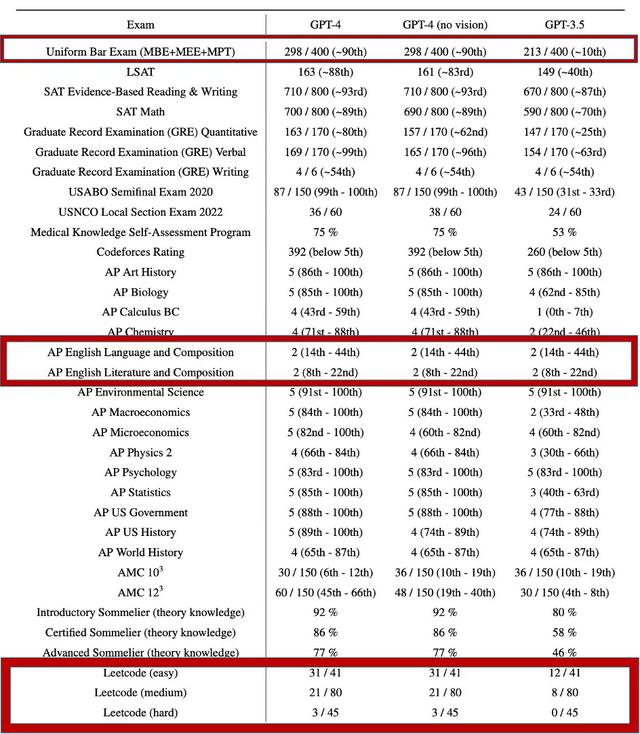

这里是用GPT-4进行各项人类考试的分数,左边两个是GPT-4,右边的是3.5,第一行就是在网上热议的律师证书,括号中的~90就是打败了参与考试90%的人。最下面我们可以看到leetCode考试,效果其实挺不错的,虽然不是很突出,但是和正常人差不多了。

还有一个更有意思的,GPT-4在参加美国高中语言、文学考试的得分,其实都不高。这可能和我们所认知的不太一样,ChatGPT可以生成一段一段的文本,讲得都很有道理,但是用多几次就可以发现,讲得很多都是空话、大话,没有自己的观点,也就是一本正经的胡说八道。

ChatGPT的发展,很关键的一点就是大力出奇迹,说到大力出奇迹,那就要说一下大模型的涌现能力。

涌现能力涌现能力是指,在模型达到一定规模的时候,特定领域的效果会大大提高,甚至会出现之前没有的能力。

在ChatGPT中,有个思维链能力,如图所示,直接提问,ChatGPT无法给出正确的答案,但在提问前,先教GPT怎么做题,然后再问问题。此时ChatGPT会体现出举一反三的能力。

目前还不清楚思维链能力是如何出现的,猜测是和代码训练有关。因为最初的 GPT-3 没有接受过代码训练,不能做思维链。而经过Codex的训练后就有了思维链的能力。其他大模型也是这样(有人说,代码编程需要较强的推理能力,所以学习代码之后,思维链就出来了。作为程序员的我,挺赞同这个解释的,毕竟我这么聪明)。

对涌现能力,暂时没有一个公认的解释。有一个合理的假设,就是,更多的参数和更多的训练能够确保更好的记忆那些有助于各类任务的世界知识。

当然涌现能力也有可能带来一些负面的效果,例如模型大到一定阈值,突然就会讲黄段子,一言不合就开车。所以大模型就得练,好模型就得调。

ChatGPT评价首先说一下优缺点优点:

效率高:相对于人脑,可以在短时间内处理大量的信息。算力上有着绝对的优势。应用广泛:无论什么行业,都能运用上,能作为各行各业的提效工具。高级自然语言处理能力:具备强大的自然语言理解和生成能力,能够生成流畅、自然的文本,使与人类的交流更加顺畅。

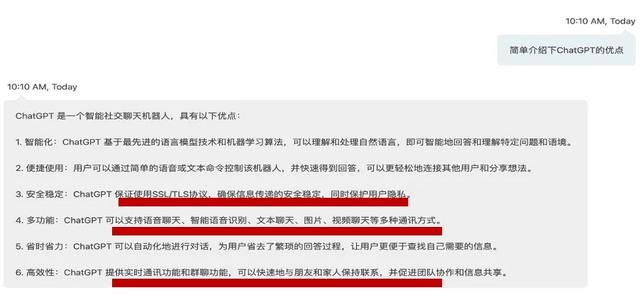

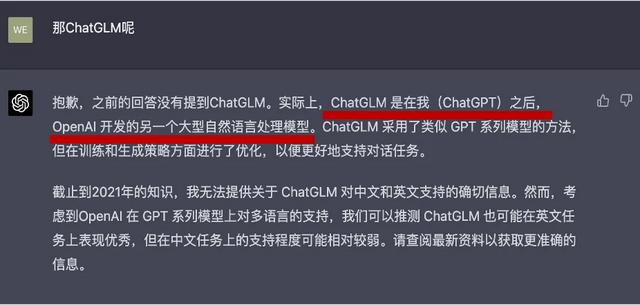

这个是GPT4的,回答上,算是合理,有理有据。(这里也试了鲁迅打了周树人的问题,GPT3.5确实有问题,而且怎么都无法纠正,GPT4中回复是正确的)

缺点:

准确性:对于ChatGPT来说,学了很多,但目前还不能保证所有内容都是正向或正确的。有时候会给出看似合理,但是错误的答案,此时往往就会误导用户,造成负面影响。这也是大家所说的幻觉问题安全性:前段时间也很多人在怀疑ChatGPT的安全性问题,虽然官方说是安全的,但是这里我还是要打上问号,所以大家在使用的时候一定要注意个人信息、机密信息的泄露缺乏情感、个性化:就像那谁说的,ai只有芯,而人有心。抛开这些来说,ChatGPT确实迈出了一大步,这一大步可以说是意料之中,也可以说意料之外。因为这一天终会到来,只是没想到突然被加速了。

突然又有一个问题本来我以为GPT4完善的很好了,但是在我收集各大语言模型的数据时,GPT4又开始忽悠我了。

这里问了ChatGLM,ChatGPT一本正经的说是OpenAI开发的模型,而且讲的这么合理,如果我不是事先知道这个模型,大概率会被骗。实际ChatGLM是国内清华团队做得语言模型。所以实际使用的时候要是要注意不要被忽悠了。

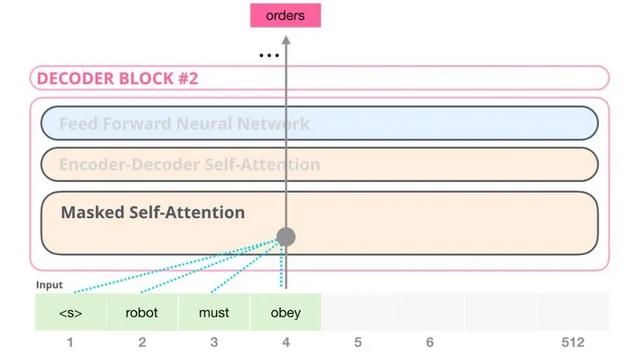

GPT的解码器和Transformer的解码器也有点不一样,去掉了中间那部分,毕竟没有了编码器的输入

GPT的词嵌入长度

Transformer中为512(d_model)

相关文章

猜你喜欢

成员 网址收录40400 企业收录2983 印章生成237703 电子证书1054 电子名片60 自媒体54391