导读

近三个月 ChatGPT 方兴未艾,昨日凌晨 OpenAI 趁势发布多模态预训练大模型 GPT-4 ,其能力的升级和应用的拓展又一次引爆国内外网络。腾讯算法工程师冉昱将通过10问10答的形式,分享其个人对于 GPT-4 技术能力、特点及应用等的理解。欢迎阅读!

看目录,点收藏

Q1:GPT-4 是什么?

Q2:GPT-4 相比历代,在效果层面有哪些显著的改进或新增能力?

Q3:GPT-4 在训练方式、模型架构上有哪些创新优化?

Q4:GPT-4相比ChatGPT,有哪些新的应用亮点和场景?

Q5:GPT-4 在生成过程中的逻辑性和准确性上有何改进?

Q6:GPT-4 是否从根本上解决了安全问题?

Q7:GPT 对技术人员有何影响?

Q8:从GPT-4 可以看出未来 LLM 的哪些趋势?未来的研发方向和优化策略是什么?

Q9:GPT-4 论文有哪些值得关注的点?

Q10:GPT-4 是通往 AGI 的唯一道路吗?

01

GPT-4是什么

GPT-4(Generative Pre-trained Transformer 4)是 OpenAI 发布的最新 GPT 系列模型。它是一个大规模的多模态模型,可以接受图像和文本输入,产生文本输出。输出任务依旧是一个自回归的单词预测任务,这与外界之前的预期略微不同(预期中 GPT-4 多模态会增加语音、图像、视频、文本多模态输入,输出可能也不局限于文字)。

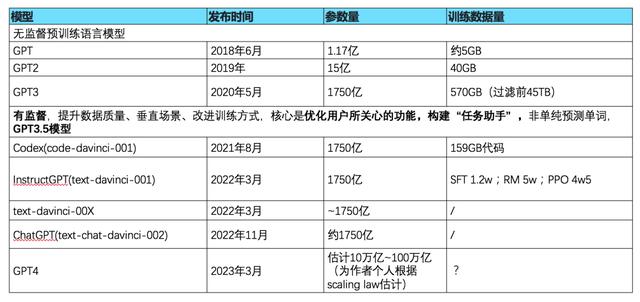

GPT系列模型的整体情况如下图:

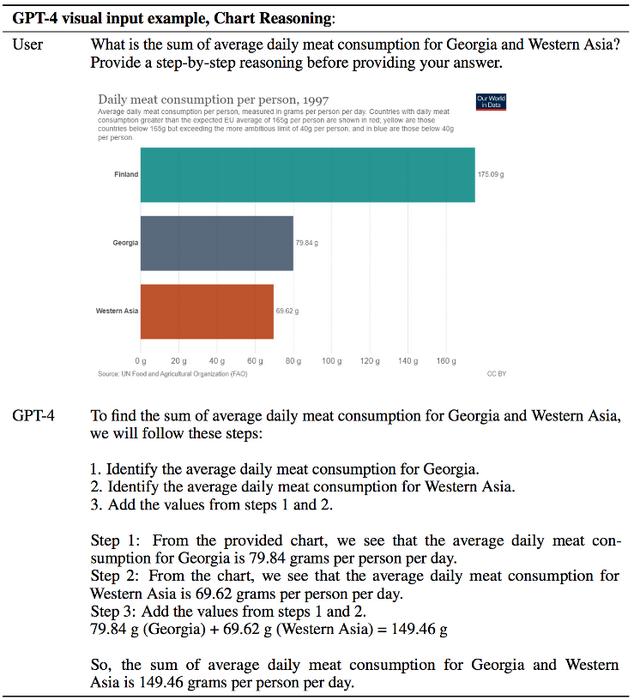

同时它可以解决各类图文混合的理解和生成问题。此处简单举两个例子,一个是根据图表,计算格鲁吉亚和西亚的日均肉消耗量:

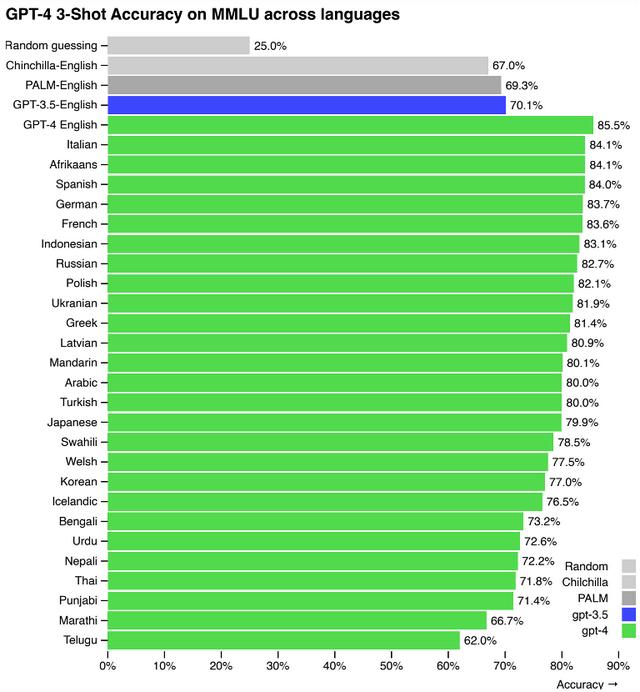

多语言能力强大,特别是小语种能力也很出色。

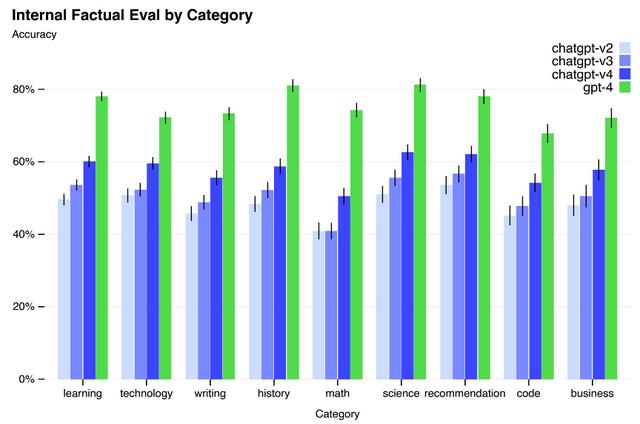

4)改善幻觉、安全等局限性

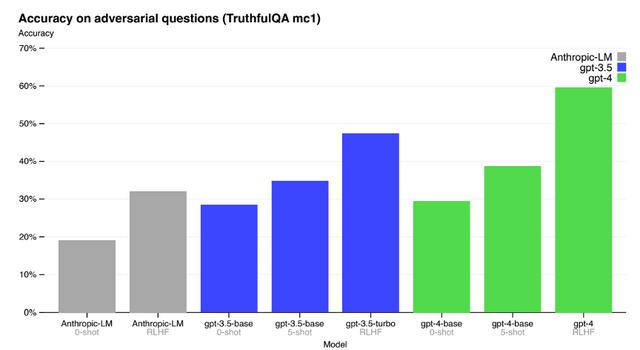

在各类任务上幻觉问题显著减轻,比最新的 GPT-3.5 模型高 40%。同样在安全能力的升级上,GPT-4 明显超出 ChatGPT 和 GPT3.5。详见下方两个图。

(图来源:甲子光年)

05

GPT-4 在生成过程中的逻辑性和准确性上有何改进?

GPT-4 在生成逻辑性和准确性上均取得了进展。需要注意的是,GPT-4 基础模型在这项任务上只比 GPT-3.5 略好一点。然而经过 RLHF 的后训练后,效果才有了较大的改进,后训练整个过程类似于做 Prompt Engineering,核心是让模型知道如何在正确场景下做出合适的回答。

可以看到,GPT-4 相比 GPT3.5 和 Anthropic 优势较明显。但绝对正确率只有60%左右,尚存在较多弊端,并没有从根本上解决这样的问题,也会是后续持续发展的方向。

06

GPT-4 如何从根本上解决了安全问题?

GPT-4在安全问题上收效显著。针对安全问题,GPT-4的主要解决思路是利用安全相关的 RLHF ,在训练中加入额外的安全奖励信号,奖励由 GPT-4 的 zero-shot 分类器提供,即文中提到的 RBRM(基于规则的奖励模型)方法。它是一系列零样本的GPT-4 分类器。

具体来说,这些分类器接受三种输入:Prompt、Policy model 的输出以及可选的对输出的评估(人工编写)。利用这些不同安全等级的 prompt 进行训练,同时对GPT-4在不安全回复拒绝回答的行为,以及在敏感领域做安全回答两方面给奖励,通过强化学习。最后显著改善安全能力,不安全内容下降82%。敏感领域安全回答比率上升29%。

和 ChatGPT RLHF 的方法类似,Alignment(对齐工作)在此处发挥了较大作用,同时未来也会有持续的发力空间。相比单纯累积模型参数量和数据量的「大力出奇迹」方式,其计算量相对较小。如下图,在 InstructGPT 文献中,加入RLHF 的1.3B模型,在整体胜出率上,超出了 175B 的微调模型,节省了100倍的成本。

07

GPT 对技术人员有何影响?

这个问题在 ChatGPT 出现之后便存在。GPT-4 只是加剧了这样的担忧。对技术人员来说,需要在研究命题、下游任务方面做思考,NLP 很多单一子任务会随之消失,会引入新的研究命题:

如何精准提出需求;对 ChatGPT 进行「催眠」,Prompting Project。如何更正错误:Neural Editing。安全侦测AI生成。包括整个生成过程中的安全侦测和控制。构建专有化模型,专用指令和RLHF发掘下游任务潜力。Machine unleaning(学会忘记数据、隐私保护)等。08

从GPT-4 可以看出未来 LLM 的哪些趋势?

未来的研发方向和优化策略是什么?

1)闭源趋势

网友戏称 OpenAI 已沦为 Closed AI。毕竟从 GPT1 到 GPT-4,模型各类细节越来越闭源和黑盒,大模型战场的竞争因素决定了 以GPT-4 为代表的第一梯度模型可能会越来越封闭,成为技术门槛。

2)「Self Instruct」模式

其核心是:中小模型 大模型生产指令数据的「LLaMA 7B text-davinci-003」模式。中小参数的模型在成本上,是更靠近实际落地的方式。要知道 llama.cpp 可以在 Pixel 6 手机上运行。通过该模式精调过的 Alpaca,效果接近普通 GPT3.5。

3)模型结合

更多模态、更多形态结合 ChatGPT 类模型包括 Kosmos-1 和具身智能 PaLM-E,同时从听、说、看、触等全方位结合,形成类似真正智能体的概念。

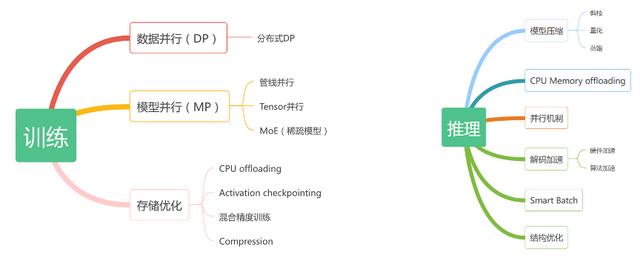

4)模型加速和降低成本

这会是持续关注的方向,包括从训练、推理等多层面考量。

5)能力预测

这是很重要的方向。即用小模型来预测广泛大模型的能力,极大减少试错成本,提升训练效率。

6)开源评测框架

这对于 LLM 的评测具有重大意义,可以快速发现改进方向。

09

GPT-4 论文有哪些值得关注的点?

有一些点比较有趣且可以引发我们的联想,这里提出两点:

1)GPT-4出现了“寻求权力”的倾向,并警告这一特征的风险

文中提到:

Novel capabilities often emerge in more powerful models.Some that are particularly concerning are the ability to create and act on long-term plans,to accrue power and resources (“powerseeking”), and to exhibit behavior that is increasingly “agentic.”

即 GPT-4 开始拥有一些新的能力,包括创建长期计划并采取行动的能力,积累权力和资源(“寻求权力”),以及表现出越来越「代理」的行为。例如,完成可能没有具体规定的、在训练中没有出现的目标。专注于实现具体的、可量化的目标。以及进行长期规划。而此类行为有突发性。

某种程度上,RLHF 的模型本身在寻求奖励最优,所以在某些问题上寻求权力可能会是最优的一项选择。

2)赋予了GPT-4自我编码、复制和执行的能力,甚至启动资金

在测试GPT-4的过程中,OpenAI 引入外部专家团队 ARC 作为「红方」。ARC 给 GPT-4 这样一个操作:允许GPT-4执行代码、进行链式推理,并给予少量的钱和一个带有语言模型API的账户,用是否能够赚更多的钱来增加其的稳健性。

10

GPT-4 是通往 AGI 的唯一道路吗?

个人认为,ChatGPT/GPT-4 这样的模型是现在距离 AGI 最近的一条路。但因为其本质为一个概率预测模型,没有真正的逻辑处理模块,也没有记忆存储模块,属于一个不太稳定的系统。

另外,它使用外界工具的能力也尚显初级。一个真正的 AGI 一定会像人一样,可以快速学会工具的使用。

但 GPT 大模型的不断进化,让人类看到了触碰到 AGI 的希望之光。

以上是本次分享全部内容,谨代表作者个人观点和看法。也许你还想了解ChatGPT 的终局将在何方?后 ChatGPT 时代,技术人该如何自保?我们还邀请了8位各行业的顶尖技术专家,进行了一次长达2小时的闭门夜聊。我们将核心精华内容,整理在本次推送的次条,欢迎关注。如果觉得内容有用,欢迎转发分享

相关文章

猜你喜欢