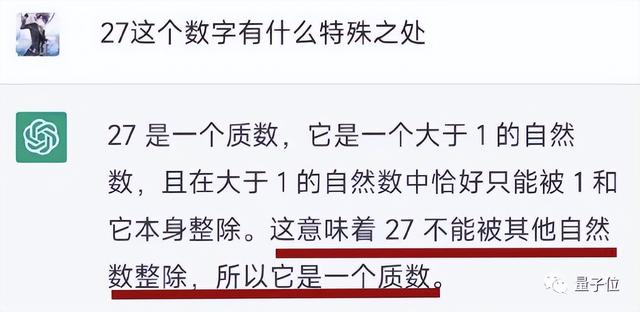

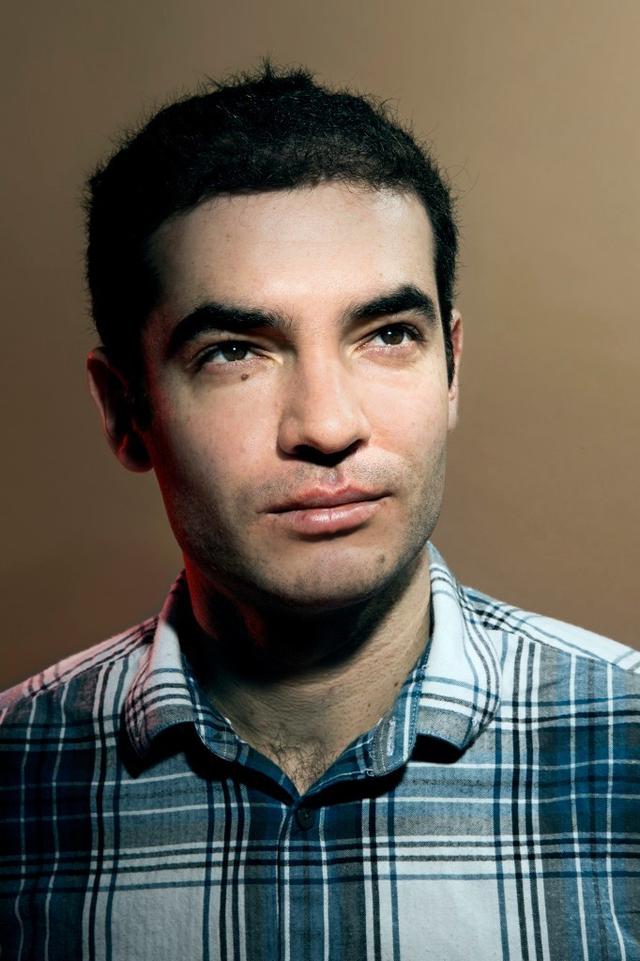

OpenAI 正在组建一个由其首席科学家兼公司联合创始人之一 Ilya Sutskever 领导的新团队,以开发引导和控制“超级智能”人工智能系统的方法。

在今天发表的一篇博文中,Sutskever 和 OpenAI 联盟团队的负责人 Jan Leike 预测,人工智能可能会在十年内实现超越人类的智能。苏茨克弗和雷克说,这种人工智能——假设它最终确实到来——不一定是仁慈的,需要研究控制和限制它的方法。

他们写道:“目前,我们还没有一个解决方案来引导或控制潜在的超级人工智能,并防止其失控。” “我们目前调整人工智能的技术,例如根据人类反馈进行强化学习,依赖于人类监督人工智能的能力。但人类无法可靠地监督比我们聪明得多的人工智能系统。”

为了推动“超级智能对齐”领域的发展,OpenAI 正在创建一个新的超级对齐团队,由 Sutskever 和 Leike 领导,该团队将有权使用公司迄今为止已获得的 20% 的计算资源。该团队由 OpenAI 之前的对准部门的科学家和工程师以及公司其他部门的研究人员加入,目标是在未来四年内解决控制超级智能 AI 的核心技术挑战。

如何?通过构建 Sutskever 和 Leike 所描述的“人类水平的自动对齐研究人员”。高级目标是使用人类反馈来训练人工智能系统,训练人工智能以协助评估其他人工智能系统,并最终构建可以进行对齐研究的人工智能。(这里,“一致性研究”是指确保人工智能系统达到预期结果或不偏离轨道。)

OpenAI 的假设是,人工智能可以比人类更快、更好地进行比对研究进展。

“随着我们在这方面取得进展,我们的人工智能系统可以接管越来越多的对准工作,并最终构思、实施、研究和开发比我们现在更好的对准技术,”Leike 及其同事 John Schulman 和 Jeffrey Wu 在一份报告中假设上一篇博文。“他们将与人类合作,以确保他们自己的继任者与人类更加一致。。。。人类研究人员将越来越多地集中精力审查人工智能系统所做的对齐研究,而不是自己进行这项研究。”

当然,没有一种方法是万无一失的——Leike、Schulman 和 Wu 在他们的帖子中承认 OpenAI 的许多局限性。他们说,使用人工智能进行评估有可能扩大人工智能中的不一致、偏见或漏洞。事实可能是,对齐问题中最困难的部分可能根本与工程无关。

但苏茨克维尔和雷克认为值得一试。

“超级智能对齐从根本上来说是一个机器学习问题,我们认为优秀的机器学习专家——即使他们还没有致力于对齐——对于解决这个问题至关重要,”他们写道。“我们计划广泛分享这一努力的成果,并将促进非 OpenAI 模型的一致性和安全性视为我们工作的重要组成部分。”

相关文章

猜你喜欢